Rangliste

Beliebte Inhalte

Inhalte mit der höchsten Reputation seit 16.05.2021 in allen Bereichen anzeigen

-

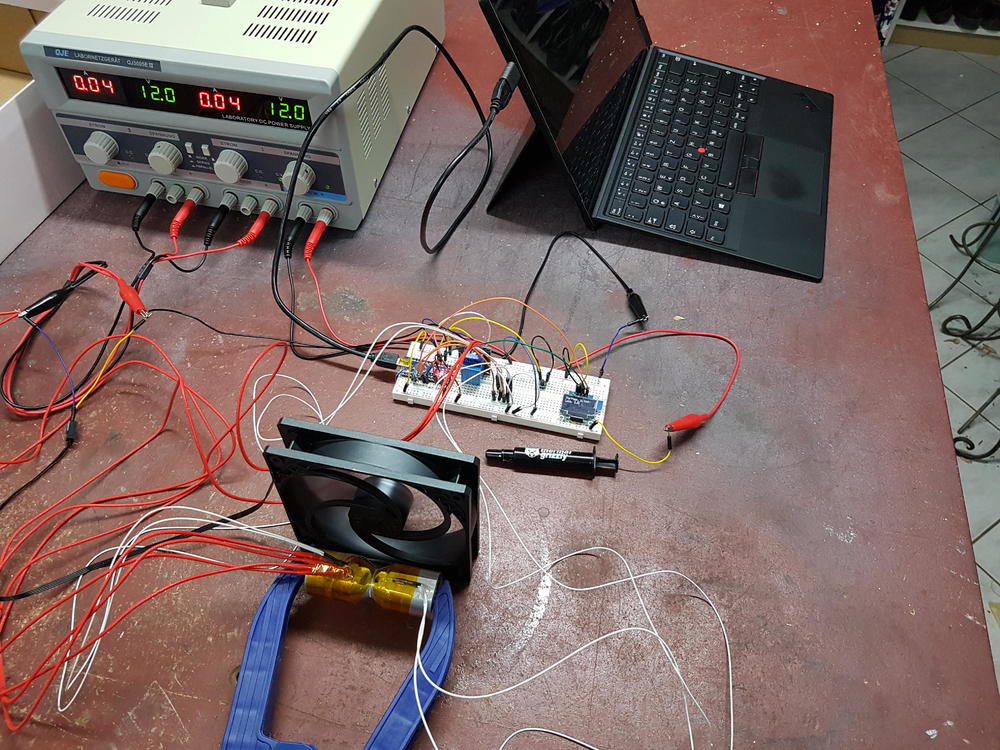

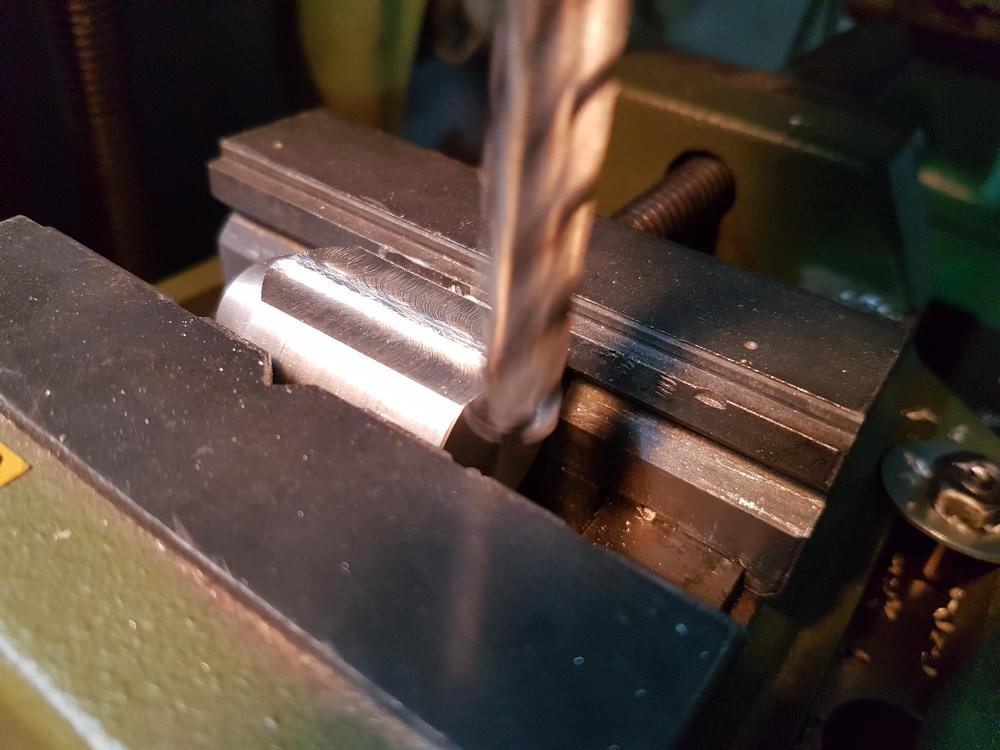

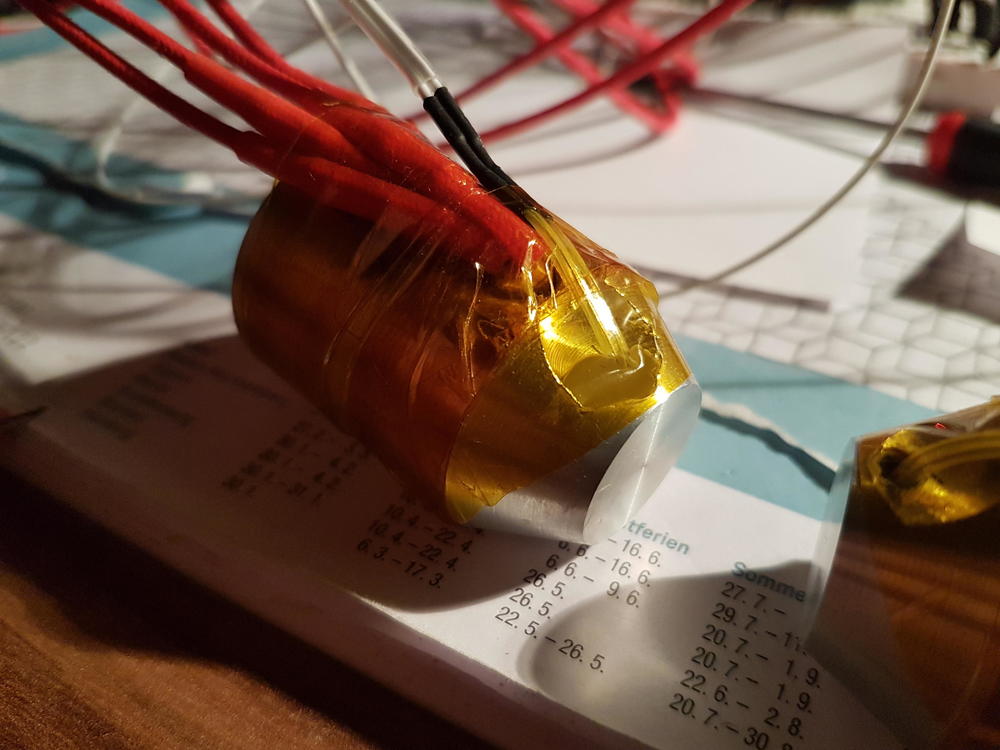

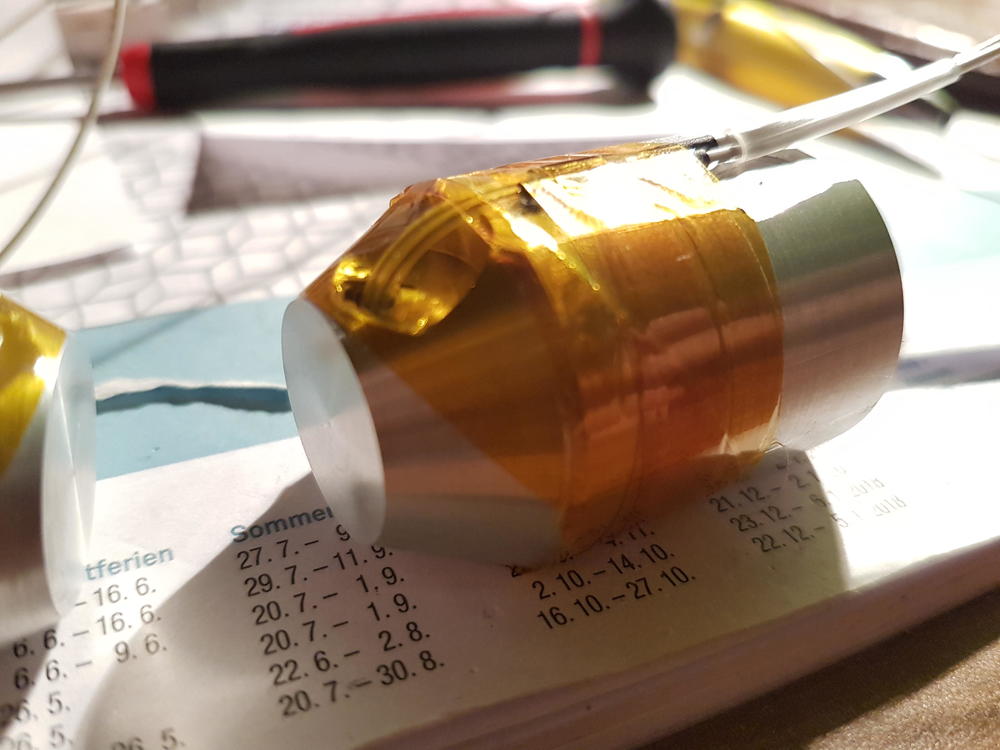

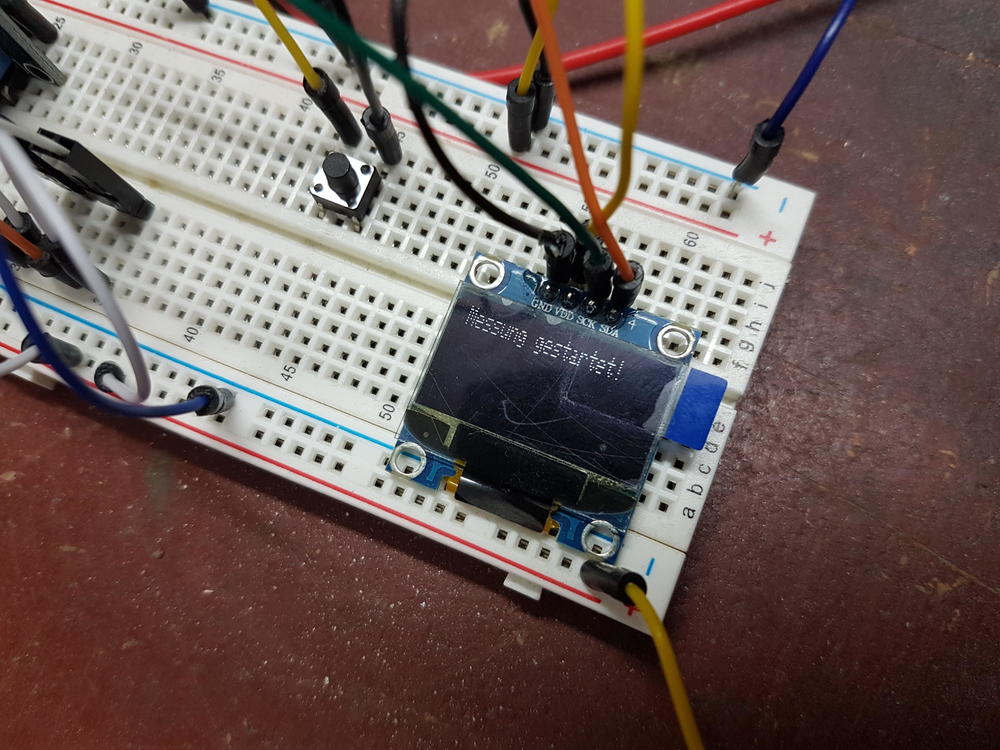

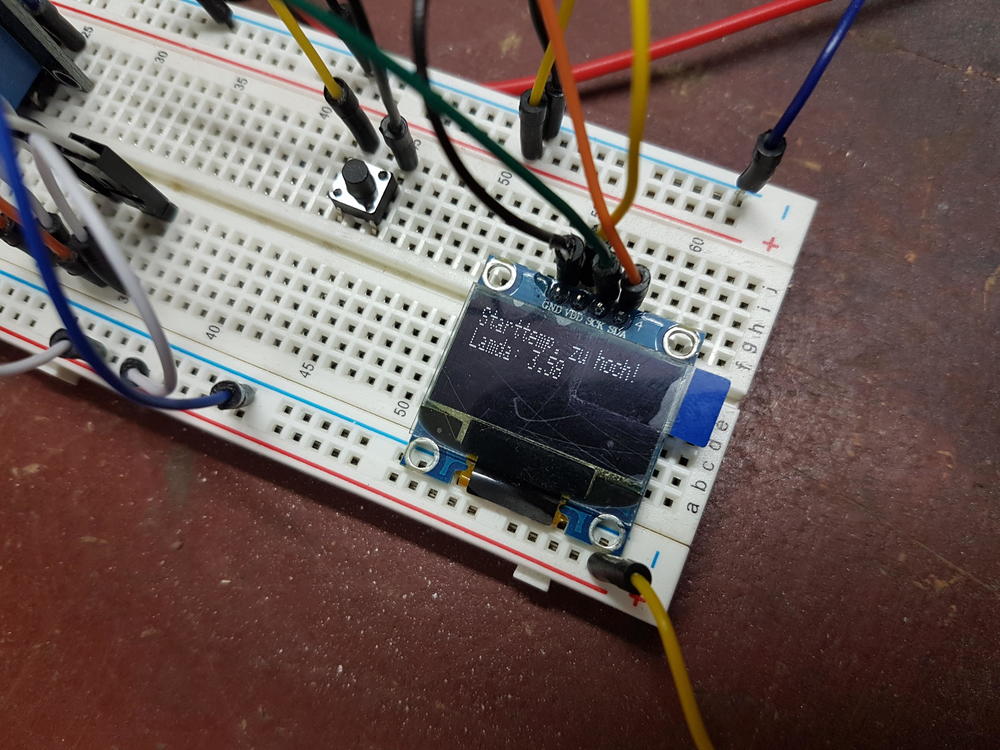

Moin zusammen, wie ihr sicher alle schon am eigenen Leib erfahren musstet, kann die Frage: "Was ist eigentlich die beste Wärmeleitpaste?" zu einem Kleinkrieg der Meinungen führen. Häufig kommen dabei Aussagen wie "Also bei mir läuft es seit dem 3°C kühler!" oder "Die Herstellerangaben stimmen nicht!" auf. Ich habe mir in den letzten zwei Wochen das Ziel gesetzt, mich mal wissenschaftlich mit dem Thema zu beschäftigen und, so hoffe ich, endlich Klarheit in diese Thematik zu bringen. Zunächst zu den oft gehörten und hier frei zitierten Aussagen: "Also bei mir läuft es seit dem 3°C kühler!" mag bei dem Autor stimmen, trägt aber keinerlei Aussagekraft für andere Systeme. Tatsächliche Abwärme, Lufttemperatur und Luftfeuchtigkeit, Nutzungsverhalten, Gehäuse, Kühloberfläche und Wärmeleitwege haben einen viel zu großen Einfluss. Selbst die Schlussfolgerung "besser als die alte Paste" ist mit Vorsicht zu genießen. Pasten altern viel zu unterschiedlich und auch die Temperatur, bei der sie getestet werden ist maßgeblich. Dazu aber im nächsten Absatz mehr. Sehr verwundert hat mich die Aussage: "Die Herstellerangaben stimmen nicht!". Ich konnte mir kaum vorstellen, dass die Hersteller auf ihren Verpackungen lügen. Viel zu groß ist die Gefahr sich damit selbst sein "Image-Grab" zu schaufeln. Bei der Recherche ist mir ein wesentlicher Punkt aufgefallen: Es steht nie dabei, in welchem Temperaturbereich der Wärmeleitwert gemessen wurde, oder bei welcher Schichtstärke. Die Wärmeleitfähigkeit von Flüssigkeiten (mit einem flüchtigen Bestandteil) nimmt mit steigender Temperatur ab. Das hängt mit dem Phasenverhalten der einzelnen Bestandteile der Paste zusammen. Wurde vom Hersteller also bei einer sehr geringen Temperatur gemessen, kann das die Wärmeleitfähigkeit positiv beeinflussen. Auch die Schichtdicke ist nicht uninteressant. Der Wärmeübergang an den Oberflächen der Paste ist schlechter als im Inneren. Also kann eine Dicke Schicht die Werte des Herstellers auch schönen. Aber Vorsicht! Das bedeutet nicht, dass eine dicke Schicht in PC besser ist. So oder so ist die Leitfähigkeit der Paste schlechter als die von Kupfer oder Aluminium. Daher sollte die Schicht natürlich IMMER so dünn wie möglich sein. Wie wir sehen konnten gibt es einige Möglichkeiten für die Hersteller die Ergebnisse zu beeinflussen. Doch wie bekommt man jetzt heraus welche Paste für welchen Anwendungsfall die beste ist? Zu diesem Zwecke habe ich mit einen Versuch überlegt. Wen nur die Ergebnisse interessieren, der kann weiter unten gucken. Für die technisch Interessierten unter euch (ich tippe auf die Mehrheit) habe ich versucht mein Vorgehen (hoffentlich verständlich) zusammen zu tragen. Grundaufbau und Idee: Der Versuch besteht aus einem leistungsstarken Labornetzteil, einem Steckbrett mit Arduino zur Datenverarbeitung, einem Laptop zur Anpassung der Prüfparameter, einem Lüfter zum schnelleren Abkühlen nach dem Versuch und.... dem eigentlichen Experiment. Das besteht aus zwei identischen Aluminiumkörpern mit Sensoren und Heizelementen. Beide Körper haben eine sehr ebene Prüffläche auf die die Wärmeleitpaste aufgetragen wird. Mit einer kräftigen Kunststoffklemme wird der Anpressdruck erzeugt. Die beiden Blöcke habe ich aus Aluminium gedreht und gefräst. Sie haben genau die gleichen Abmaße, was bei der Berechnung der thermischen Kapazität wichtig wird. Außerdem habe ich die Messoberfläche sehr fein geschlichtet, um eine spiegelnd glatte und Ebene Auftragsfläche für die Paste zu erzeugen. Anschließend habe ich den ersten Block mit zwei Keramikheizelementen ausgestattet. Diese eigenen sich besonders gut, da sie die Wärme über einen elektrischen Widerstand erzeugen und somit einen Wirkungsgrad von fast 100% haben. Jedes Element hat ca. 40W Wärmeleistung. Außerdem habe ich einen Temperaturfühler (NTC-Thermistor mit 100k) nur einen Millimeter hinter der Messfläche in der Mitte angebracht. Der zweite Block bekam nur einen Sensor und keine Heizelemente. Die Idee hinter dem Aufbau: Wenn der erste Block erwärmt wird beginnt ein Wärmestrom durch die Prüffläche und die Wärmeleitpaste in den zweiten Block zu fließen. Dieser Wärmestrom ist, in Abhängigkeit der Schichtdicke, der Auflagefläche und der Temperaturdifferenz, begrenzt durch den Wärmeleitwert zwischen den Prüfflächen. Thermodynamik 🤮 Ich muss zugeben, dass Thermodynamik nicht mein Lieblingsfach im Studium war. Jedoch ist das hier ein relativ einfacher Zusammenhang und somit nicht ganz so sauer, wie es meiner Überschrift aufstößt. Für die Berechnung des Wärmeleitwerts benötigen wir folgende Größen: Den Wärmefluss Qp [W] Den Abstand zwischen den Messflächen l [m] Die Fläche der Messflächen A [m²] Die Temperaturdifferenz der Messflächen dT [°K] Gesucht ist der Wärmeleitwert lamda [W/m*K] = [W*m/m²*K]. Nun ist leider die Wärmeleistung der Heizelemente nicht gleich dem Wärmefluss zwischen den Blöcken. Jeder kennt dieses Phänomen aus dem Alltag. Stellt man einen Topf auf den Herd, so dauert es eine Weile, bis er heiß genug zum kochen ist. Das liegt an der Wärmekapazität. Um das zu erklären ist es zunächst wichtig zu verstehen, dass Wärme und Temperatur nicht die gleichen Dinge sind. Wärme ist eine Energieform, weshalb ihre Einheit auch Joule oder Wattsekunde ist - daher auch der Wärmefluss in Watt! Die Temperatur gibt an, wie viel Energie in Abhängigkeit der Wärmekapazität ein einer bestimmten Menge eines bestimmten Stoffes enthalten ist. Das ist sehr kompliziert ausgedrückt, was im Grunde auch jeder von zuhause kennt. Man braucht mehr Energie um ein kg Wasser zu erhitzen als ein kg Luft. Die Einheit der Wärmekapazität ist J / kg * K (Joule pro Kilogramm mal Kelvin). Aluminium besitzt eine Wärmekapazität von 900 J/kg*K. Da ein Joule gleich einer Wattsekunde ist, kann man sagen, dass man 900W braucht um 1kg Alu um ein Grad Kelvin in einer Sekunde zu erwärmen. Werden nun beim Versuch die Blöcke erwärmt, kann man anhand dieses Zusammenhangs und der Heizdauer die Leistung berechnen, die in das Alu geflossen ist. Rechnet man die beiden Leistungen der Blöcke zusammen. Erhält man eine Leistung, die knapp unter der Elektrischen Leistung liegt. Die Differenz ist Wärme, die von den Blöcken an die Luft abgegeben wurde. Daraus wird ein Korrekturwert berechnet, der zusammen mit der Leistung des zweiten Blocks den Wärmestrom durch die Paste ergibt. Ab hier ist es einfach. Der Anstand der Messflächen ergab sich als 0,05mm und die Oberfläche ist aus der Konstruktion bekannt. Somit kann der Wärmeleitwert berechnet werden. Versuchsdurchführung und Ergebnisse Durch einen Druck auf einen kleinen Taster wir die Messung gestartet. Von der Raumtemperatur ausgehend habe ich auf 35°C, 50°C und 100°C erhitzt. Am Ende des Versuchs wurde mir das Messergebnis auf einem kleinen OLED angezeigt. Ich habe auch die Wärmeleitfähigkeit eines Motoröls gemessen, da diese dort sehr genau im Datenblatt angegeben wurde und konnte damit die Richtigkeit meiner Messergebnisse sehr gut belegen. Alle Werte lassen sich mit einer Genauigkeit von 0,02W/m*K reproduzieren. Ich habe folgende Pasten getestet: Thermal Grizzly Kryonaut fast 5 Jahre alt aber noch sehr flüssig und nicht eingetrocknet angegeben mit 12,5W/m*K Thermal Grizzly Kryonaut 1g Packung (war bei meinem Kühlblock dabei) kein Jahr alt aber schon ziemlich hart aber noch nicht trocken angegeben mit 12,5W/m*K Industrielle Wärmeleitpaste angegeben mit 1,73W/m*K Wärmeleitmittel 20°C bis 35°C 20°C bis 50°C 20°C bis 100°C Luftspalt (0,01mm) 0,17 W/m*K X X Thermal Grizzly (0,05mm) alt 7,03 W/m*K 4,24 W/m*K 1,68 W/m*K Thermal Grizzly (0,05mm) 1g Packung 2,40 W/m*K 1,48 W/m*K 1,48 W/m*K Motoröl 15W40 0,48 W/m*K 0,38 W/m*K 0,24 W/m*K Industriepaste 3,58 W/m*K 1,97 W/m*K 1,32 W/m*K Alle Angaben mache ich nach bestem Wissen und Gewissen aber ich hafte natürlich nicht für etwaige Fehler, die mir bei der Messung unterlaufen sein könnten. Als nächstes möchte ich gern von euch wissen, welche Pasten am interessantesten zum testen sind. Ich werde mir auf jeden Fall frische Thermal Grizzly Kryonaut und Arctic MX5 besorgen. Aber wenn ihr noch interessante Pasten für mich habt, lasst es mich gerne wissen. In Zukunft soll mein Prüfaufbau das Steckbrett verlassen. Ich werde eine Platine und ein eigenes Netzteil mit interner Leistungsmessung ergänzen um die Genauigkeit und die Bedienfreundlichkeit zu erhöhen. Falls ihr Ideen dazu habt auch immer her damit. Vielleicht hat ja sogar der eine oder andere an einem fertigen Produkt. Ich hoffe Ihr habt Spaß mit meinem kleinen Versuch und findet die Ergebnisse (die noch folgen werden) hilfreich. LG11 Punkte

-

Kurztest Razer Blade 18 und Asus Scar G18 So, hab sowohl das Blade 18 als auch das Scar G18 ausgepackt und getestet. Am interessantesten für mich war, wie viel Leistungsaufnahme die (starken) CPUs bei Dual-Load in einem noch erträglichen (4X dbA) Lüfter-Profil ("Balanced" oder ähnlich) abführen können/dürfen. Außerdem war für mich interessant, wie die Charakteristik der Lüfter ist. Zur (permanenten, also PL1) CPU-Leistungsaufnahme im „Balanced-Mode“. Bei z.B. FarCry 6, was auch ordentlich CPU-Leistung für viele fps möchte, fällt die CPU bereits nach kurzer Zeit auf ca. 45 W (Blade 18) bzw. 55 W (Scar G18). Das ist definitiv zu wenig, hierdurch fallen die fps auch ordentlich und CPU-Limits verschärfen sich deutlich. Für mich indiskutabel: FarCry 6 Savegame im CPU-Limit (wenig Load auf der GPU) im Leistungs-/Lüfter-Profil "Balanced" (beim Scar G18 heißt es „Leistung“) 10900K (Area 51m R2) bei um die 125 W: 92 fps 13950HX (Blade 18) bei um die 45 W: 103 fps 13980HX (Scar G18) bei um die 55 W: 118 fps 13900K (Mini-ITX-Desktop) bei um die 105 W: 161 fps Hinweis 1: Der in der Überschrift genannte Leistungs-/Lüfter-Modus bezieht sich natürlich nur auf das Blade 18 und Scar G18, das Area 51m R2 lief im Silent-Modus und der Desktop ja eh völlig individuell Hinweis 2: Beim Area 51m R2 wird bei um die 125 W im Silent-Profil (!) das langfristige Temp-Limit erreicht, sonst wären wohl noch paar fps mehr drinnen. Würde die GPU voll arbeiten, wären aber etwas weniger Watt möglich, aber wie gesagt: Silent-Profil! Die anderen beiden Laptops dürfen halt einfach langfristig gar nicht mehr (PL1) Hinweis 3: Egal ob die GPU voll arbeitet oder nicht, beim Desktop wird bei um die 105 W mein langfristige Temp-Limit erreicht (das Mini-ITX-Gehäuse ist ja sehr klein und es wird ein kleiner CPU-Kühler verwendet, den ich auch noch zusätzlich auf leise getrimmt habe. Was der 13900K aber bei um die 105 W abliefert, ist ja absolut beeindruckend). Mit mehr Lüfter-rpm und/oder einem größeren CPU-Kühler würden noch mehr als 161 fps möglich sein. Der Abstand zu den mobilen Top-CPUs bei Dual-Load in den 18er Laptops ist ja aber jetzt schon riesig. Bei um die 90 W liefert der 13900K übrigens noch immer 156 fps - wie gesagt 161 bei um die 105 W). Hinweis 4: In dem Beispiel / Spiel mögen für viele auch bereits die 92 fps des Alienware Area 51m R2 / 10900K ausreichend sein. Aber erstens gibt es üblere Stellen im Spiel, und zweitens gibt es mittlerweile so einige Spiele, wo man die fps quasi durch 2 teilen kann, und dann bleibt bei allen Laptops nicht mehr viel über bzw. nicht einmal stabile 60 fps in entsprechenden Szenen. Das mag bei solchen Spielen auf schlechte Entwicklung / Optimierung / Ports zurück zu führen sein, aber was will man machen, wenn einem diese Spiele gefallen... Das Scar G18 ist schneller als das Blade 18, was nicht nur durch die höhere Leistungsaufnahme zu erklären ist. Einer der Gründe ist die etwas besser taktende CPU, ein weiterer vielleicht der Ram (nicht verglichen). Beim maximalem Leistungs-/Lüfter-Profil (5X dbA) sind dann im gleichen Test ca. 65 W bei beiden dauerhaft möglich. Natürlich liegen die ersten wenigen Minuten bei beiden über 100 W an. Ein so lautes (Hilfe!) Lüfter-Profil ist für mich indiskutabel. Zudem ist die Leistungsaufnahme für meinen Geschmack immer noch zu wenig: FarCry 6 Savegame im CPU-Limit (wenig Load auf der GPU) im maximalen Leistungs-/Lüfter-Modus 10900K (Area 51m R2) bei um die 125 W: 92 fps 13950HX (Blade 18) bei um die 65 W: 110 fps 13980HX (Scar G18) bei um die 65 W: 118 fps 13900K (Mini-ITX-Desktop) bei um die 105 W: 161 fps Die ganzen Zahlen schwanken minimal, ist quasi jeweils ungefähr ein Mittelwert. Es geht ja auch nicht darum, ob es hier und da 1-2 fps weniger oder mehr sind, man sieht überall große Unterschiede. An der Stelle nochmal gesagt: Es geht hier um ein CPU-Limit, die GPU ist jeweils bei weitem nicht ausgelastet. Es spielt also keine Rolle, dass im Mini-ITX-Desktop eine schnellere 4080-Desktop-Karte verbaut ist, die fps-Differenzen kommen alleine durch die CPU-Unterschiede zu Stande. Übrigens werden die CPUs der beiden Laptops, auch im maximalen Leistungs-/Lüfter-Profil, im Dual-Load schon sehr heiß. Das künstliche Limit also z.B. mit ThrottleStop zu umgehen (sofern möglich) würde hier nicht viel bringen. Viel ist halt relativ, müsste man testen und schauen ob einem das reicht. Ich habe auch mal beim Blade die Leistung der GPU deutlich reduziert (weit unter 70 W), dann hat die CPU in FarCry 6 tatsächlich - scheinbar dauerhaft zwischen deutlich bessere 90-110 W geschwankt. Aber ab 70-80 W auf der GPU (und das braucht man ja mindestens schon...) fällt sie dann auf die genannten ca. 65 W ab. Wahrscheinlich irgendwann so oder so. 90-110 W bringen übrigens schon 12X-13X (je nach Laptop) fps bei FarCry 6, aber man wird sie halt nur in den ersten wenigen Minuten zu Gesicht bekommen... (im CPU-Limit in genau diesem Savegame bzw. an der Stelle im Spiel). Wie ich gestern schon gepostet habe, kann das MSI GT77 Titan oder auch das XMG Neo 16 (sicher auch 17) teilweise mehr als 65 W durchschnittlich abführen (laut computerbase.de), und das auch bei Dual-Load. Das Blade 18 und Scar G18 jedoch nicht, wenn die GPU stock oder auch mit UV arbeitet. Und das ist definitiv in manchen Spielen ein riesen Nachteil (heftigeres CPU-Limit hier und da). Ich glaube nicht daran, dass es beim m18 großartig anders sein wird. Und das MSI oder das XMG gefällt mir nicht bzw. lässt so viel Leistungsaufnahme auf der CPU auch nur in (für mich) viel zu lauten Leistungs-/Lüfter-Profilen zu, was ja bekanntermaßen für mich sowieso ein absolutes Ausschlusskriterium ist. Das würde natürlich auch das m18 betreffen. Zur Charakteristik der Lüfter Blade 18: Gar nicht so übel, auch wenn ich es nicht rauschig nennen würde. Rauschig ist es für mich erst, wenn ein Lüfter sich mehr rauschig anhört, als die anderen Geräusche. Ein Area 51m R2 würde ich als rauschig bezeichnen, auch wenn man dort noch was anderes raushört, aber das macht eben keine 50% aus. Richtig rauschig sind meines Erachtens z.B. gewisse Desktop-Lüfter von Noctua Scar G18: Schlechter finde ich. Hat noch weniger mit Rauschen zu tun, irgendwie mehrere unangenehme Geräusche. Zudem heftiges coil-whine, was ich beim Blade 18 nicht bemerkt habe. Es ist lauter wie bei einigen Highend-Desktop-GPUs... Auf die Lautstärke jeweils brauche ich nicht einzugehen - beide viel zu laut. Und leiser betreiben ist wegen zu starker Drosselung, sei es thermisch oder künstlich, nicht vernünftig möglich. Display: Allgemein: 18 Zoll wirken erstmal mega toll und modern (dünner Rand für so ein großes Display). Und man benötigt eigentlich auch kein 27“ mehr auf dem Schreibtisch, man ist ja näher dran. Aber viele von euch nutzen ja eh größere Displays als 27 Zoll auf dem Schreibtisch. Blade 18: Katastrophe, wie @pitha1337 schon schrieb. Flickering vom Feinsten (auch in Windows - das wird sicher noch irgendwann gefixt), dazu sieht man das „Netz“ des Displays. Bei der Auflösung bei 18“ müsste das nicht sein, ist einfach kein gutes Panel. Scar G18: Deutlich besseres / zufriedenstellendes Panel, ohne die Farben beurteilt zu haben. Ich gehe auch nicht auf Glowing und Clouding ein, das haben beide ganz gut gehabt... Anmutung & Qualität Blade 18: Natürlich super gut. Scar G18: In live deutlich wertiger als ich bisher so an Bildern und Videos gesehen habe. Ich habe es aber auch bisher nur kurz mit Tageslicht gesehen. Meine aber auch die Oberflächen und das wenig knarrt oder sowas. Sollte man sich aber auf jeden Fall live anschauen, wenn der Rest passt / es einen interessiert Auf Tastatur, Design, Sound, Webcam, Akkulaufzeit usw. gehe ich jetzt nicht ein. Wenn ihr Fragen habt, schießt los. Dann noch für @captn.ko Undervolting @ CPU: Hab wirklich keinen Nerv das noch zu testen, sorry, zumindest nicht mehr heute. Ich schicke es aber erst Montag oder so zurück, insofern ist noch Zeit. Wie im Artikel von gestern steht, geht beim Scar G18 nur 30 mV übers Bios, beim Blade sicher nicht mehr. Und selbst wenn, die CPU hat andere Probleme - auch mit UV… PL-Reduktion @ GPU: Ist bei beiden über z.B. Afterburner möglich, im Gegensatz zu älteren Ampere-/Turning-Laptops. Noch besser - vorallem für Teillast - ist natürlich die Reduktion der Maximalspannung (UV) über z.B. den Afterburner Curve Editor (was natürlich auch wie immer funktioniert). Computerbase hatte aber mit der PL-Reduktion über Afterburner teilweise Probleme, so dass sich nicht alle Spiele daran gehalten haben. Das habe ich jetzt nicht getestet. Fazit Wie ich hier geschrieben hatte, benötige ich (nun definitiv glücklicherweise) nicht mehr unbedingt ein Gaming-Laptop, und werde mein Mini-ITX-Desktop behalten bzw. einen Zweiten für meine Frau bauen (welcher das Area 51m R2 Laptop ersetzt. Für mobile Zwecke bzw. Mitnahme Urlaube / Hotels, wo wir nicht zocken, haben wir ein 16" Macbook Pro). Nach diesem Test sind im Prinzip alle Gaming-Laptops - unabhängig vom Lüfter-Profil - nicht für mich (als Haupt-Spiele-PC) zu gebrauchen. Ein Area 51m (R2) durfte noch im Silent-/Balanced-Profil ins CPU-Temperatur-Limit laufen (und das entsprechende Kühlsystem hierzu war vorhanden!), das hätte man wenigstens wieder so machen können, anstatt in leisen und mittleren Lüfter-Profilen künstliche Leistungsaufnahme(TDP)-Limits zu setzen. Schade, aber schon seit Jahren bei allen Herstellern und Modellen die ich kenne Normalität. Aber manche Modelle würden auch wegen schlechtem Kühlsystem nicht mehr Leistungsaufnahme im entsprechenden Lüfter-Profil schaffen, teilweise macht es also Sinn... außerdem liegen so nicht immer 95-100 Grad an, was den Käufer beruhigt. Im Vergleich zum 13900K im Desktop ist die mobile Variante - unabhängig der Leistungsaufnahme - deutlich langsamer wie man sieht. Aber das war ja schon immer so und wird wohl auch so bleiben. Das einzige was wirklich toll ist, ist natürlich die Effizienz bzw. die Perfomance der CPUs bei nur 45-65 W. Aber wenn man den Desktop-13900K auf 45-65 W reduzieren würde, wäre das ähnlich. Ich glaube man muss abschließend einfach festhalten und akzeptieren, dass eine hohe dauerhafte (PL1) Leistungsaufnahme von z.B. um die 100 W auf der mobilen CPU bei gleichzeitiger GPU-Load - wenn überhaupt (bei vielen Gaming-Laptops schon mal nicht) - nur mit sehr lautem Leistungs-/Lüfter-Profil möglich ist, was für mich absolut nicht in frage kommt. Es müsste sich vorher für mich also grundlegend das Kühlsystem ändern und/oder die Chips dürften nicht mehr so viel Leistungsaufnahme benötigen. Vorher kann wohl kein Gaming-Laptop mehr für mich in frage kommen. Eine absolute Ausnahme war eigentlich das Area 51m (R2). Möglicherweise auch das Clevo X170KM-G/XMG Ultra 17 (hatte ich nie getestet und wird wie das Area 51m nicht mehr mit aktueller Gen versorgt). Im Grunde hat sich also mit der neuen Gaming-Laptop-Generation jetzt gar nichts geändert. Die 18 Zoll Gaming-Laptops sind in allem etwas besser, aber eben halt auch nicht mehr. edit: Drei Hinweise unter den fps-Werten (FarCry 6 Test) hinzugefügt.10 Punkte

-

Ich würde dir als erstes mal empfehlen, zu versuchen dich klar auszudrücken. Entschuldige das ich es so sage, aber bei deinem Geschreibsel bekommt man echt Augenkrebs. Wenn du der Meinung bist die Lüfter funktionieren nicht, dann starte dein Notebook und drücke dabei F12. Im folgenden Menü wählst du Diagnostics aus. Da kann man die Lüfter einzeln testen.6 Punkte

-

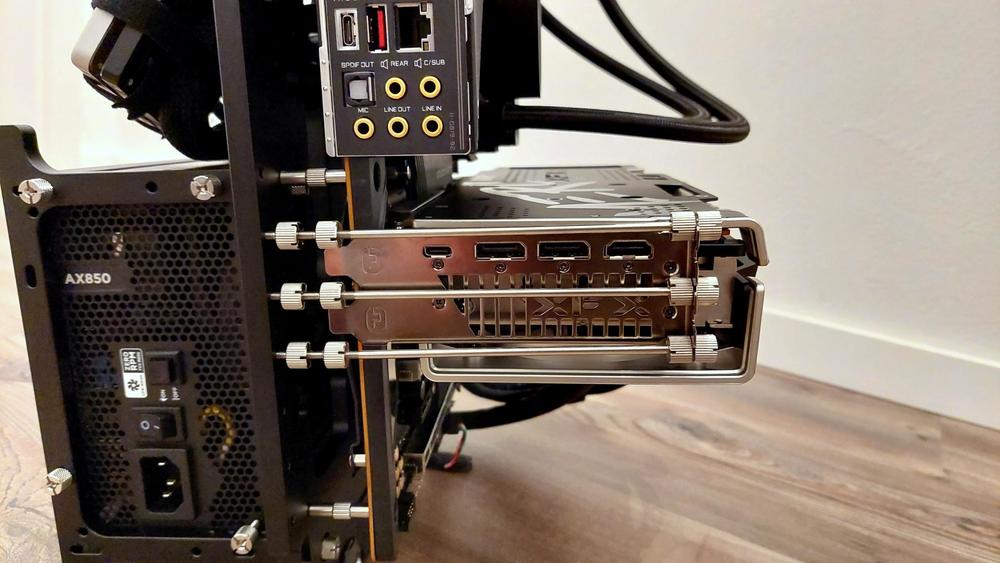

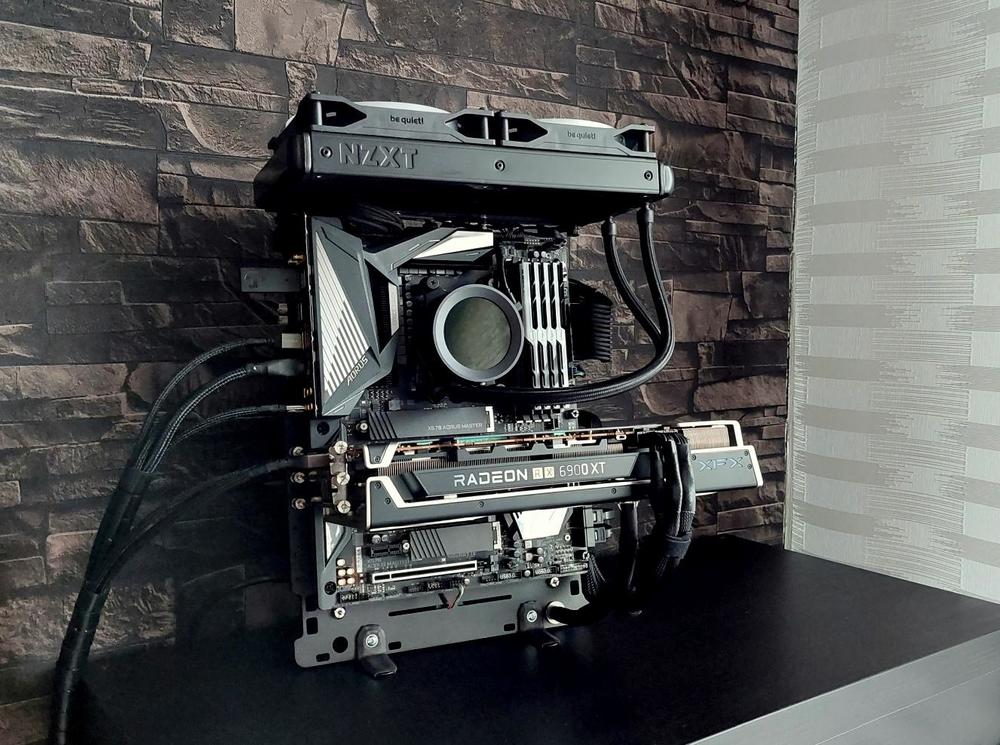

Zum einen mit den drei Streben links, die erstaunlicher mehr Halt geben als gedacht und zum anderem mit einem selbst angefertigtem Anti-Sag-Mount. Hab halt drei Streben genommen, um die maximale Stabilität zu erreichen. Ich wusste aber schon vor dem Kauf, dass eine Lösung gegen GPU-Sag bei diesem "Gehäuse" definitiv ein Problem werden wird. Insbesondere bei der langen und schweren Karte, die ich habe. Letztendlich dachte ich mir, dass mir schon eine passende Lösung einfallen wird, wenn ich das Case zu Hause habe. Für den Anti-Sag-Mount habe ich dann ein 12mm dickes Aluminiumrohr genommen, es auf den passenden Winkel gebogen, ein Gewinde oben und unten reingeschnitten und schwarz lackiert. Das Teil ist so stabil, das hält die GPU mit Leichtigkeit alleine. Bin jedenfalls sehr zufrieden damit. Auch Standfüße gegen das nach vorne Kippen musste ich mir anfertigen. Das war jetzt aber weniger ein Problem. Hab jetzt die Tage noch ein wenig Beleuchtung montiert und bin soweit jetzt erstmal fertig. Bin sehr zufrieden mit dem Gehäuse. Ist einfach mal was anderes und nimmt nur sehr wenig Platz ein. Leise ist es auch, da kaum Lüfter verbaut sind.6 Punkte

-

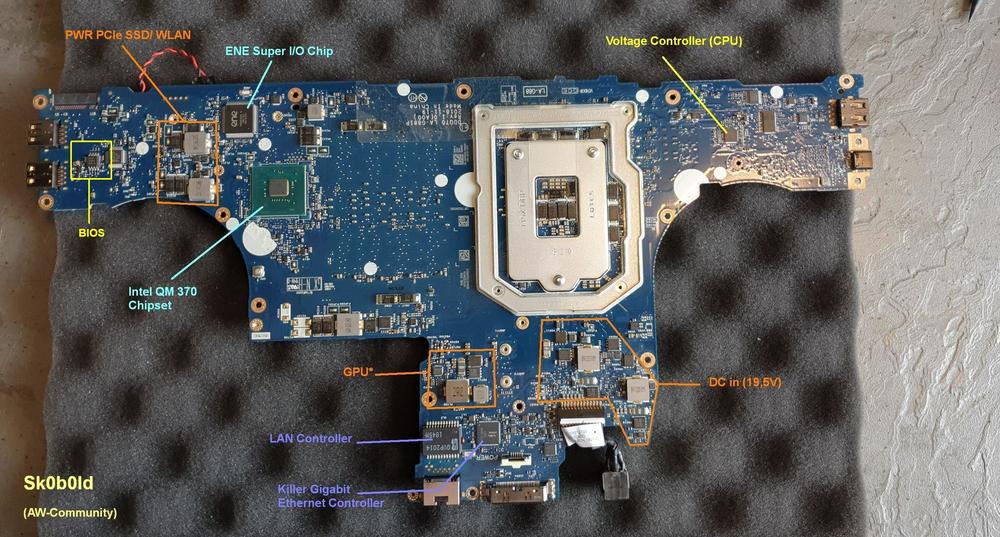

Ich gehe mal davon aus, dass du nichts "gelöscht", sondern einfach Secure Boot von enabled auf disabled gestellt hast. Korrigiere mich da bitte, falls ich falsch liege. Wäre mir aber neu, wenn man da einfach irgendwelche Einträge löschen kann. Ansonsten sehe ich da kein Problem, dass du irgendwelche Settings dort angepasst hast. Dafür ist das BIOS schließlich auch da. Zunächst mal was Allgemeines zu der ganzen BIOS-Geschichte und den vielen Lösungsansätzen. Es hilft ungemein, wenn man sich einmal vor Augen hält, was das BIOS eigentlich macht, wie es arbeitet und welche Funktionen es implementiert hat. Hört sich möglicherweise etwas komisch an, erklärt aber das aktuelle Verhalten und die gescheiterten Lösungsansätze bislang, auch wenn man jeden einzelnen Ansatz an der Stelle löblich erwähnen muss, denn so ein Engagement zur Lösungsfindung ist ja auch nicht selbstverständlich. Jedenfalls, wenn man den Lappy/ Rechner startet, beginnt das BIOS-Programm mit dem Power On Self Test (POST). Dies ist eine vordefinierte Reihenfolge, wo verschiedene Hardware gecheckt wird. Vereinfacht gesagt, BIOS: "CPU bist du da?" CPU: "jo, bin da." BIOS: "RAM, bist du da?" RAM: "jo, bin da." usw. In der Realität werden natürlich weitaus mehr Daten ausgetauscht, aber die Funktionsweise sollte verständlich sein. Viele werden das von euch auch schon lange kennen, aber ich werde auf diesen Punkt immer wieder zurückkommen, deshalb spreche ich es jetzt an. Man muss immer Hinterkopf behalten, dass viele Funktionen wie das Boot- oder Recovery-Menü eine Funktion eines funktionierenden BIOS ist. Ist das BIOS aber beschädigt, lassen auch diese Funktionen normalerweise nicht mehr starten. Nach jetzigem Wissensstand, schätze ich, dass das BIOS einfach beschädigt ist. Warum das BIOS aber beschädigt wurde, ist schwer zu sagen. Vielleicht ist ein Bug im BIOS selbst, so dass eine ganz bestimmte Einstellung dazu führt, dass das BIOS fehlerhaft gespeichert wird. Vielleicht gab's beim Speichern selbst irgendwie ein Problem. Lag ein Undervolting-Offset zufällig vor? Wurde beim Speichern bzw. beim erneuten Booten der USB-Stick oder andere Hardware währenddessen entfernt (Wackelkontakt oder ähnliches)? Speziell diese UV-Geschichte ist gar nicht so neu. Viele betreiben ihr Notebook mit einem UV-Offset, vergessen aber schnell, dass man bei einem BIOS-Update das UV-Offset vorher herausnehmen sollte. Wenn dann mitten im BIOS-Update (oder beim Speichern von Settings) die CPU abschmiert, ist das BIOS meist unbrauchbar danach. Auch Schadsoftware auf dem USB-Stick könnte eine Ursache sein. Halte ich zwar für sehr gering, aber ausschließen will ich es auch nicht. Nicht jede Schadsoftware ist für Windows gemacht und damit im OS sichtbar. Ist halt ein bisschen verdächtig, dass es ausgerechnet nach dem Ausstellen von Secure Boot zu dem Problem gekommen ist. Dann die Sache mit den Peep-Codes. Das Gedudel anfangs ist der Hinweis, dass ein Boot-Fehler vorliegt. Dann piept er 3x, dann 2x und am Ende 1x und anschließend geht die Schleife von vorne los. In deinem Fall gehe ich davon aus, dass das BIOS beschädigt ist und er (das BIOS-Programm) den POST nicht vernünftig abschließen bzw. starten kann. Allein die Tatsache, dass der 1x Beep-Code (BIOS ROM-Fehler) da ist, erklärt wahrscheinlich den 2x- und 3x Beep-Code. Warum der 3x-Beep-Code vor dem 1x- und 2x-Beep-Code kommt, kann ich nur spekulieren (wahrscheinlich Reihenfolge des Speicherns und Ausgeben unterschiedlich). Demnach gehe ich davon aus, dass das fehlerhafte BIOS-Programm gar nicht PCH und RAM abcheckt und entsprechend auch keine Antwort erhält, wodurch die Fehlercodes automatisch hinterlegt werden. Wie gesagt, dass ist nur ein Erklärungsversuch meinerseits, der aber nicht zwingend stimmen muss. Jedoch macht das für mich am meisten Sinn, weil ich davon ausgehe, dass RAM und PCH völlig in Ordnung ist. Auch den Lösungsansatz mit der SSD halt ich für wenig erfolgversprechend. Das BIOS interessiert ein bootbares Medium erst, wenn alles ordnungsgemäß durchgelaufen ist. Da aber das BIOS schon vorher rumzickt, wird die SSD zu dem Zeitpunkt noch gar nichts zu melden haben. Den Lösungsansatz mit dem RAM wird wahrscheinlich auch nicht zum Erfolg führen, auch wenn ich diesen Lösungsansatz gut nachvollziehen kann. Ich habe diesen Fehler bei einem Alienware-Gerät mal provoziert. Der Fehler kommt meist zustande, wenn beim POST die RAM-Daten (Timings, Sub-Timings, Voltage) aus dem SPD-Speicher fehlerhaft gespeichert und nicht auf dem RAM angewendet werden können. In meinem Fall hat nur noch ein CMOS-Reset geholfen, damit das BIOS die RAM-Daten aus dem SPD-Speicher neu einliest. Die genannten Punkte sind keineswegs falsch und werden zum Teil auch so im Service-Manual erwähnt. Tatsächlich ist es in der Realität aber etwas anders. Die Stromkreise bei dem BIOS-Chip laufen in der Regel getrennt voneinander. Mal ein anderes Beispiel in dem Zusammenhang: Viele Desktop-Mainboards, ab einer bestimmten Preisklasse (meist OC-Feature) haben einen Clear CMOS-Button (viele min. ein Jumper). Dieser Knopf unterbricht einfach nur die Stromzufuhr von der CMOS-Batterie zum BIOS-Chip. Hier reicht schon eine Unterbrechung von weniger als eine Sekunde aus, um den BIOS-Chip komplett auf Default zu setzen. Wenn man RAM-OC macht, ist das Feature (oder ReTry) echt Gold wert. Im Beispiel Laptop und Service-Manual, wird aber meist eine Vorgehensweise empfohlen, die auf nahezu alle Notebook-Typen (idiotensicher) übertragbar ist. Deshalb Powerdrain, 5-15 Minuten CMOS-Batterie abklemmen, Akku raus usw. Wenn ich richtig informiert bin, hat das schon fast historische Hintergründe, wo in den damaligen Notebooks Kondensatoren und andere Elektrokomponenten verbaut wurden, die deutlich länger den Strom gespeichert haben und auch die Stromkreise und BIOS-Chips waren anders. Da an der Vorgehensweise aber nichts falsch ist, hat's man immer dabei belassen. Ich will damit nur sagen, dass modarim an sich schon alles richtig gemacht und es keinen Unterschied mehr macht, ob er die CMOS-Batterie 5 Minuten oder eine Stunde abklemmt. Wenn das Notebook einmal vollständig (inkl. CMOS) stromlos war, war das schon richtig so. Ja, weil die Recovery-Funktion, eine Funktion eines funktionierenden BIOS ist. Ich will natürlich nichts ausschließen und keinen Lösungsversuch ungetestet lassen, aber ich würde meine Erwartungen nicht zu hoch setzen. Das Area 51m-Mainboard hat mehrere BIOS-Chips. Mit etwas Glück läuft die Recovery-Funktion vielleicht über den anderen Chip. In den allermeisten Fällen, in einem Preisbereich, wo es sich aus meiner Sicht nicht mehr lohnt, derart viel Geld in ein "altes" Gerät zu investieren. Meist bist du über 1.000€ los und das für irgendeinen gebrauchten Kram und wenn das Board am Ende immer noch nicht läuft, verlierst du noch mal Geld. Für's gleiche Geld (+ das, was für das Area 51m noch bekommst) kannst du auf ebay KA schon ein fast gleichwertiges, funktionierendes Gerät holen. Vielleicht sogar schon besser. Ich gehe jetzt nicht auf jeden Lösungsversuch ein, verweise aber nochmals auf den am Anfang genannten Punkt mit der Funktionsweise des BIOS. F12 mit Bootloader-Menü wurde bereits bestätigt, dass es nicht geht. Demnach braucht er auch kein DVD-Laufwerk oder sonst was anzuschließen. Diese Geschichte mit der CD/ DVD ist sowieso nur im Legacy-Mode vordefiniert, wo man kein Bootmanager zur Verfügung hat, sondern eine feste Prio bzw. die man selbst festlegt. Mit UEFI hat man auch zeitlich den Bootmanger aktiviert, der automatisch nach'm MBR sucht. AHCI/ RAID on ist ein Punkt ja, aber soweit kommt erst gar nicht. Dieser Punkt ist erst interessant, wenn der POST durchgelaufen ist und es darum geht, wie die bootbaren Laufwerke angesprochen werden sollen. Externe Gerät werden ziemlich funktionieren (drehen und leuchten), da auch andere (Strom-)Komponenten wie Tastaturbeleuchtung, Lüfter, Lautsprecher etc. funktionieren. Teilweise läuft der 5V-Kreislauf ohne Logik und wird direkt ausgegeben. So wie auch Charge-USB usw. Ehrlich gesagt, sehe auch hier die größten Erfolgschancen. Das Gerät, welches man dafür braucht, ist -DAS- beispielsweise. Ich sag aber gleich vorab, dass ich damit keine Erfahrung habe. Ich hab es nur zufällig einmal im Einsatz gesehen. Wie so oft im Leben, muss man sich das mit Youtube und Co. wahrscheinlich selbst beibringen oder kennt jemanden zufällig. Falls alle Stricke reißen, hab ich vielleicht jemanden da (weiß nicht, ob er das macht. Muss ich selbst fragen). Der BIOS-Chip ist in der Regel ein achtbeinige Winbond-Chip (Vergleichsbild). Ich habe auch Bilder vom Area 51m R1 Mainboard da (im VRM-Thread), welcher aber der Main-BIOS Chip ist, weiß ich nicht exakt. Hier mal das Mainboard von beiden Seiten: Auf den ersten Blick, würde ich die beiden Chips auf der linken Seite vermuten, tendenziell den auf der Rückseite als Main. Oberhalb und rechts vom RAM finden sich noch zwei weitere Winbond-Chips, die etwas kleiner sind. Glaube zwar nicht, dass die mit dem BIOS was zu tun haben, aber völlig ungeachtet würde ich sie auch nicht lassen. Der oberhalb vom RAM wird ziemlich sicher für RAM-Profile sein. Anhand der CMOS Batterie und des Pin-Layout des BIOS-Chips, sollte man relativ leicht rausfinden können, welcher der BIOS-Chip ist.6 Punkte

-

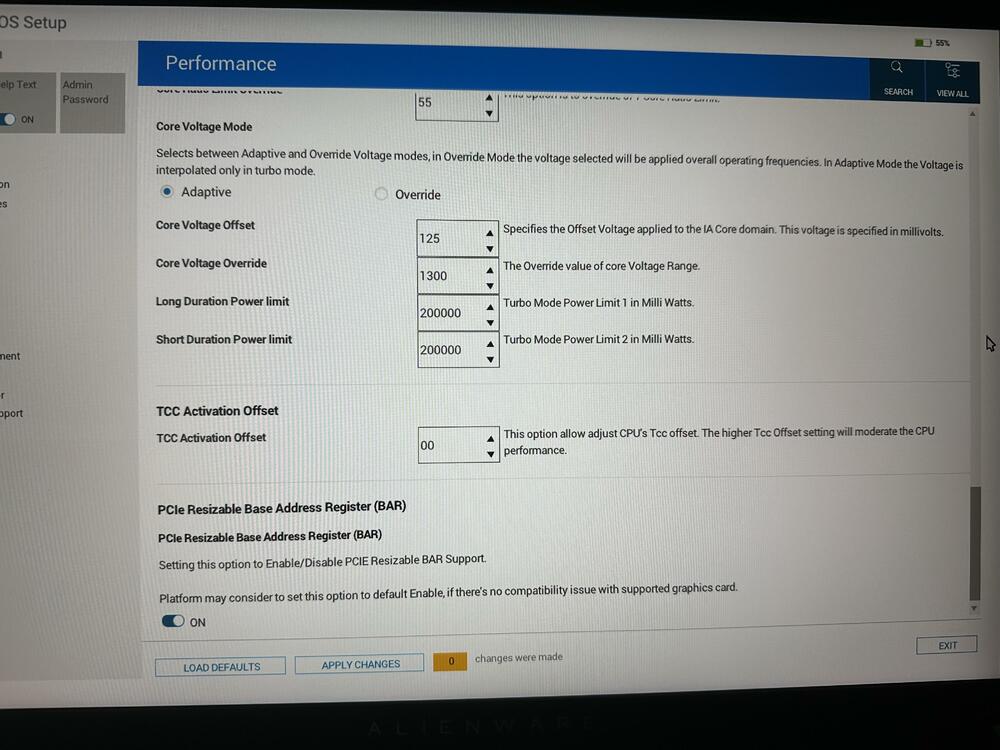

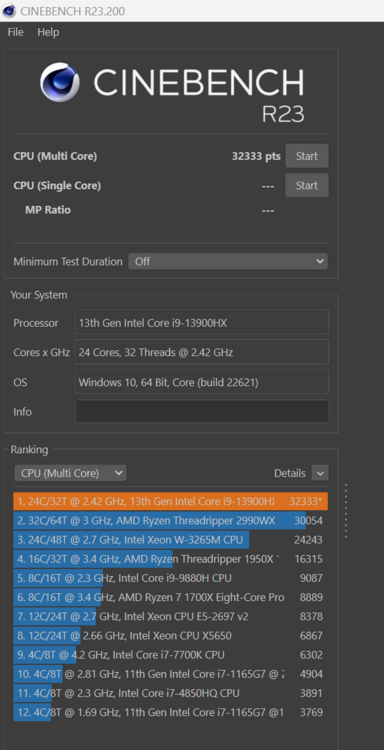

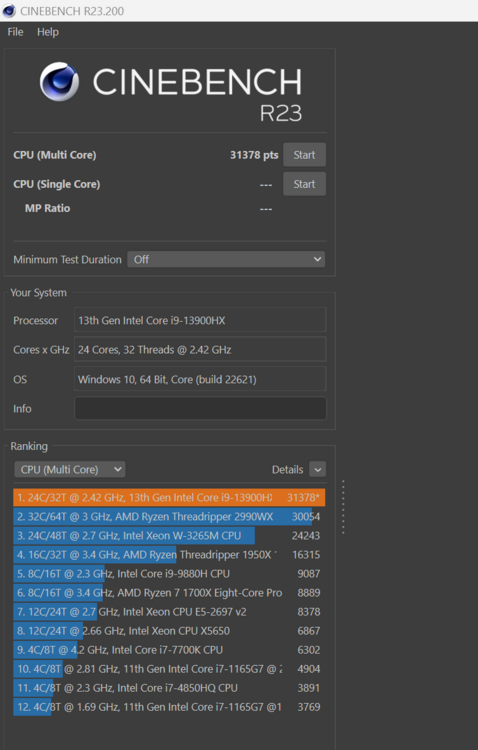

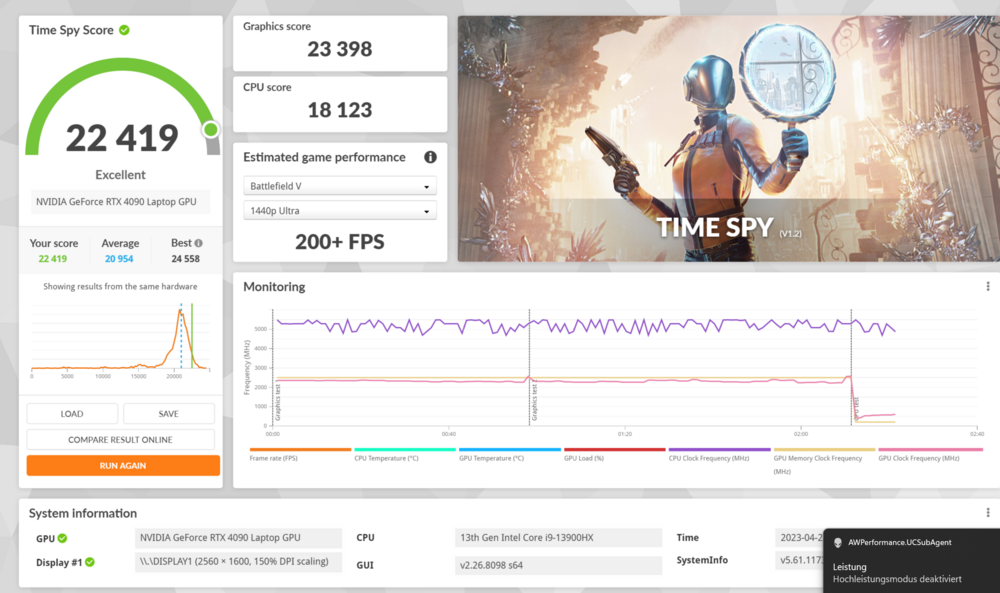

So sieht das unter performance im BIOS bei mir aus Hier noch mein Score mit den Settings von oben und im Overdrive Modus (AWCC). Bitte beachte aber, das ich komplett auf richtiges Liquid Metal gewechselt habe auf CPU und GPU. Hier noch der Score mit dem Performance/Leistung Modus im AWCC: Hier noch ein TS mit zusätzlich 250/1000Mhz OC auf GPU:5 Punkte

-

Das habe ich nicht probiert, ich musste irgendwann mal meine custom Settings laden und dann habe ich OC wieder aktiviert und den UV eingestellt. Bisher läuft das m18 astrein und am stärksten von allen von mir getesteten RTX4000er Notebooks. Ich weiß nicht ob es an Alienware liegt, aber hier steht Gaming im Fokus und das merkt man. Es funktioniert einfach Repaste kann sicherlich noch mehr rausholen, aber nicht zwingend notwendig. Sehr positiv überrascht bin ich tatsächlich vom Sound und von den Lüftern. Wenn ich mir was wünschen dürfte dann wäre es die Displayqualität aus dem Blade 16 und das Farbdesign vom X17/Area51m Ansonsten alles Top 👍🏻5 Punkte

-

Wenn du den nach Deutschland bringst wird Einfuhrumsatzsteuer fällig. Ich glaube kaum das sich das dann rechnet wenn noch mal 19% drauf kommen. ,,Überschreitet eine Ware die Freigrenze, etwa ein Notebook für 850 Euro, musst Du 850 Euro verzollen. Die Einfuhrabgaben sind auf den Gesamtwert der Ware zu bezahlen und nicht nur auf den Anteil, der die Freigrenze übersteigt.,, https://www.finanztip.de/einfuhrzoll/ Klar könnte man behaupten das man das Ding vor der Reise gekauft hat aber erkläre dann mal die QWERTY Tastatur. Doof sind die ja auch nicht und: ,,Befinden sich nach Abzug des Freibetrags Waren für mehr als 700 Euro im Gepäck und werten die Behörden das Verhalten als nicht nur leichtfertig, leiten die Zöllner in der Regel ein Strafverfahren wegen versuchter Steuerhinterziehung ein.,, Auf einen Versuch würde ich es nicht ankommen lassen. Wäre mir zu viel HickHack und potentielles Theater, seis wegen Zoll oder Garantie.5 Punkte

-

Egal wie früh du nach News schaust, pitha schaut früher!😂😉😎5 Punkte

-

Moin, ich bin neu hier im Forum. Eigentlich wollte ich mich letztes Jahr schon bei Euch anmelden, nachdem ich den Aurora R11 zum Geburtstag geschenkt bekommen hatte. Hier nochmal ein kurzer Hinweis für die Admins. Bei einer neu Registrierung kann ich nur ältere Alienware Rechner auswählen. Der R11 oder auch mein jetziger Rechner, der R13 ist leider nicht mit auswählbar, das nur kurz zur Info Nun zum eigentlichen Thema. Ich bin seit Anfang Januar 22 stolzer Besitzer eines Aurora R13 mit folgender Config: Aurora R13 mit Kyro Tech + Seitenfenster und zusätzlicher Seitenabdeckung I9-12900KF 32GB DDR5 mit 4400 MHz Geforce RTX 3080 LHR 750 Watt Netzteil Eigentlich war ich letztes Jahr bereits mit dem R11 unzufrieden. Permanente Throttling Probleme durch Überhitzung der CPU (I7-10700 KF) machten mir zu schaffen und war kurzzeitig am überlegen ob ich das ganze System wieder an Dell zurücksende. Durch den Engpass der Grafikkarten hab ich mich aber dazu entschlossen das System zu behalten und habe jede Menge Arbeit reingesteckt um das System in den Griff zu bekommen. Dabei wurden jegliche Lüfter ausgetauscht, eine neue und bessere Wärmeleitpaste verwendet und die CPU "undervoltet", als auch entsprechend die Wattzahl bei TDP PL1 und 2 geändert. Seitdem läuft der Rechner recht zufriedenstellend. Nicht perfekt aber ok. Seit der Ankündigung des R13 war ich sofort verknallt. Für mich ist der R13 vom Design her einer der schönsten Computer die ich bisher gesehen habe und ich habe schon etliche gesehen (wie immer Geschmacksache). Ich bin 51 Jahre alt und habe mir über die Jahre meine PC's immer selber zusammengestellt und zusammengebaut. Ich bin mittlerweile aber auch faul geworden und durch die jetzige Marksituation interessieren mich Komplettsysteme mehr, da ich auch bei Dell bzw Alienware einen 3 Jahre Premium Support genieße (beim 11er sind es 2 Jahre). Wie dem auch sei, beim R11 musste ich durch den Lockdown letztes Jahr knapp 3 Monate auf die Lieferung warten und war überrascht das es beim R13 gerade mal 1 Woche gedauert hatte. Vom Bestellprozess bis zur Lieferung war das für Dell Verhältnisse Lichtgeschwindigkeit! Nun zum eigentlichen Feedback des Aurora's R13: Ich habe die Kiste auf der Dellseite mit gerade mal 3 von 5 Sternen bewertet, warum das ? Trotz der Kyro-Tech Lösung und des größeres Gehäuses + der 2 zusätzlichen Lüfter, habe ich das gleiche Problem wie damals mit dem R11. Das Ganze System drosselt in kürzester Zeit wenn R23 läuft, dabei wird der komplette Rechner so unerträglich laut (wie beim R11 nur noch ein tick lauter) das ich es kaum mehr am Arbeitsplatz aushalte und ich den Computer 2 Räume weiter immer noch als störend empfinde. Unglaublich aber war, Dell hat leider immer noch nichts dazu gelernt und ich bin mir sehr sicher, das der I9-12900KF völlig ungeeignet für eine 120mm AiO Kühlung ist. Vielleicht ist es beim I7-12700KF etwas anderes, aber ich kann den I9 für dieses System leider nicht empfehlen. Ich verstehe auch nicht, wie man so einen Computer auf den Markt schmeißen kann (da er ja sogar in Kooperation mit Intel entstanden ist und Intel für diesen auch Werbung macht). Der Dell Kundendienst ist hierbei auch mal wieder eine Katastrophe da die Mitarbeiter leider kein Plan haben. Außer ein zurücksenden oder Gutscheine für den nächsten Einkauf, können die einem nicht wirklich weiter helfen. Also was tun, zurücksenden ? nein...ich will und möchte den Rechner dennoch behalten und eigentlich bin ich auch ein alter Alienware Fanboy 😉 Was hab ich getan. Nun, das Gleiche wie damals mit dem R11. Als Wärmeleitpaste habe ich diesmal die Thermal Grizzly Kryonaut Extreme genommen und habe dadurch ca. 2 bis 3 Grad einsparen können. Auch die Lüfter habe ich mit den Noctua NF-A12x25 PWM chromax.black.swap getauscht. Hierbei eine kleine Info. Nicht die Noctua NF-A12x25 PWM in Braun nehmen, da beide Lüfter nicht zentriert im vorderen Gehäuse sitzen. Es sieht etwas dämlich aus, wenn man vorn auf dem Rechner sieht und 2 braune Lüfter durch Luken die nicht zentriert sitzen. Leider klappt das "Undervolting" mit ThrottleStop nicht mehr vernünftig unter Windows 11. Kein Plan warum, aber jedesmal wenn ich dort eine Einstellung vornehme läuft der komplette Rechner mit gefühlt 1Mhz und es hilft nur ein Reboot. Überhaupt ist Windows 11 bisher eine Vollkatastrophe. Ich frage mich welche Drogen bei Microsoft konsumiert werden. Viele Programme wie ThrottleStop (einer meiner wichtigsten Tools) funktionieren nicht mehr vernünftig und es liegt nicht am Tool, sondern an den Sicherheitseinstellungen von Windows 11. Spiele wie bspw Star Citizen liefen auf Win10 wesentlich weicher und flüssiger mit meinem R11 (wo ist der Performancesprung mit dem MS für Win11 seit Ewigkeiten wirbt ?). Die ganze Oberfläche ist sehr gewöhnungsbedürftig. Aber leider muss ich ja Win 11 nutzen um das volle Potenzial des I9 auszuschöpfen. Ich muss nun auf XTU zurückgreifen, da mir das AW Bios auch keine Möglichkeiten bietet, dass Throttling in den Griff zu bekommen (eigentlich ein Wahnwitz für ein System das knapp 4K kostet). Ich habe eine etwas aggressivere Einstellung in XTU eingestellt. Core Voltage Offset und die Performance/Efficient Cache Voltage Offsets habe ich mittlerweile auf -0,120 V und die CPU auf 125 Watt beschränkt. Im Boost für 56 Sekunden auf 190 Watt. Der Rechner läuft nun sauber und rund, wird nicht mehr so heiss und ist dadurch auch schön leise. So wie es eigentlich sein müsste. Aber nein, ich habe dadurch leider wieder heftigste Performance Einbußen. Im R23 kann ich zufrieden sein die 18K im Multi zu knacken. Hier übrigens mal ein Link zum Thread den ich direkt bei Intel gepostet habe, da mir Dell wie ich ja erwähnt habe, außer ein zurücksenden nicht weiterhelfen konnte. Der Thread ist leider in englisch und ich bin im englisch leider nicht so bewandert ...vielleicht interessiert es den ein oder anderen ja. https://community.intel.com/t5/Processors/INTEL-DIAGNOSTIC-TOOL-FAILING-Brand-String-CPUFreq/m-p/1356498/emcs_t/S2h8ZW1haWx8dG9waWNfc3Vic2NyaXB0aW9ufEtaNE5BTEg5UE5VWFFVfDEzNTY0OTh8U1VCU0NSSVBUSU9OU3xoSw#M56196 Lange Rede, kurzer Sinn...kann ich den Aurora R13 mit I9 empfehlen ? ganz klares NEIN! Dell hat außer dem schicken Design nichts dazu gelernt. Es werden immer noch Bauteile verbaut, die nicht wirklich zusammen passen. Dell wirbt nun, das durch die Größe des neuen Gehäuses nun die Möglichkeit besteht, in Zukunft bessere und längere Grafikkarten zu verbauen, was an sich ja auch ein cool und ein Sprung nach vorn ist. Nur was nutzt mir ein 750 Watt Netzteil wenn ich eine 3090TI einbauen möchte ? Facepalm5 Punkte

-

Ich und die meisten User hier würden dir dringend davon abraten einen Desktop von Dell zu kaufen. Ich selbst wollte auch mal einen alienware Desktop kaufen. Ein area51 oder ein Aurora. Das im Aurora nur sehr kurze gpus rein passten hat mich zum glück davon abgehalten es zu kaufen. Ich hab mir dann ein System von Mindfactory zusammen bauen lassen mit meiner wunschkonfiguration für über 1000 Euro günstiger als ein vergleichbares Alienware Aurora. Die Nachteile des aurora welche mir gerade einfallen - billigste Materialen - zu teuer - schlechte Kühlung - zu kleines case für große gpus - schlechte Software - Sehr schlechte Leistung im vergleich zu denselben Komponenten in einem guten case. - zu laut Aber aktuell würde ich jetzt kein System mit 3070 kaufen 1,5 Jahre nach Release und noch über UvP.5 Punkte

-

Alienware Aurora R13 eine riesen Enttäuschung Hallo liebe Community, ich hatte mich seit langer Zeit auf einen Alienware gefreut, also habe ich mir für viel Geld den neuen Aurora R13 gekauft. Leider ist das Gerät eine riesen Enttäuschung und wird auch mein letztes Gerät von Dell gewesen sein. Der PC ist laut und wird einfach nur extrem heiß 100° inklusiver CPU Drosselung (Streetfight Flüssigkeits Kühlung). Auch die groß angepriesene Cryotech Kühlung dürfte laut anderen Berichten und Aussage des Kundendienstes nicht ausreichend für dieses System sein. Selbst wenn Ihr später mal Teile wechseln wollt, könnt Ihr das nur bedingt, da Dell anscheinend nur Hauseigene Teile als Kompatibel ansieht und das BIOS sodermaßen abgespeckt und nutzlos ist, dass ihr dort wenig einstellen könnt. Ihr wollt die "Düsentriebwerks-Lüfter" tauschen? Reines Glücksspiel, durch Dells internes Überwachungssystem bekommt Ihr den Bios Fan Error. Ihr könnt keine Lüfter Ports deaktivieren oder freilassen ohne das dieser Fehler auftritt. Das Alienware Commandcenter ist eine Katastrophe und höchstens für die RGB Beleuchtung zu gebrauchen. Lüfterkurven könnt Ihr damit nicht vernünftig einstellen. XMP Profil ist im BIOS gesperrt, der Arbeitsspeicher ist auf 4400 MHZ begrenzt, obwohl er 4800 MHZ könnte. Wenn Ihr nicht von vornherein für 300€ die Cryokühlung und das Fensterseitenteil kauft, bekommt Ihr einen PC der innen nicht schwarz ist, sondern metallisch. Außerdem fehlt das Lightbar mit dem Schriftzug Alienware im Innengehäuse. Ein späteres Upgrade mit Dell-Teilen ist aber eh hinfällig da Ihr noch nicht mal DELL'S Hauseigene Teile nachkaufen könnt. Entweder sind diese nicht verfügbar oder der Kundendienst hat keine Ahnung wovon Ihr überhaut sprecht.... Fragen an die Fa. DELL: - Seit Jahren sind diese Probleme bekannt, vor allem die der starken Hitzeentwicklung, warum ändern Sie das nicht? - Wenn Sie ein neues Produkt designen, wird das überhaupt bei Ihnen getestet? - Ich erwarte als Endkunde von Ihnen ein Produkt mit dem ich Spaß habe und keins an dem ich selber basteln muss um z.B. Temperaturen in den Griff zubekommen. Und wenn Sie dem Kunden so ein schlecht designtes Produkt zusammenstellen finden Sie dann nicht, dass Sie dem Kunden die Freiheit lassen sollten simple Teile wie Lüfter durch hochwertigere Produkte als Ihre auszutauschen, ohne danach vor gravierenden Problemen zustehen? Bitte fügen Sie Ihrem System wenigstens die Möglichkeit hinzu, Lüfterports über das BIOS zu deaktivieren oder geben Sie uns eine Möglichkeit diese BIOS Fehlermeldungen auszublenden.... Sie würden vielen Kunden einen großen Gefallen tuen, mit nur solch kleinen Änderungen. Sie könnten dieses leicht über ein Update ermöglichen. FAZIT: Wenn man Premium Hersteller sein will, dann muss man es auch richtig machen! Ich bin sehr enttäuscht über meinen Einkauf bei Ihnen... Vielen Dank für Ihre Aufmerksamkeit. Habe diesen Text mal ins DELL Forum geschrieben. Vielleicht hilft es dem Ein oder Anderen bei der Entscheidungsfindung oder DELL ändert mal grundlegend etwas an Ihrem System. VON MIR GIBT ES FÜR DEN AURORA R13 EINEN DICKEN DAUMEN NACH UNTEN!5 Punkte

-

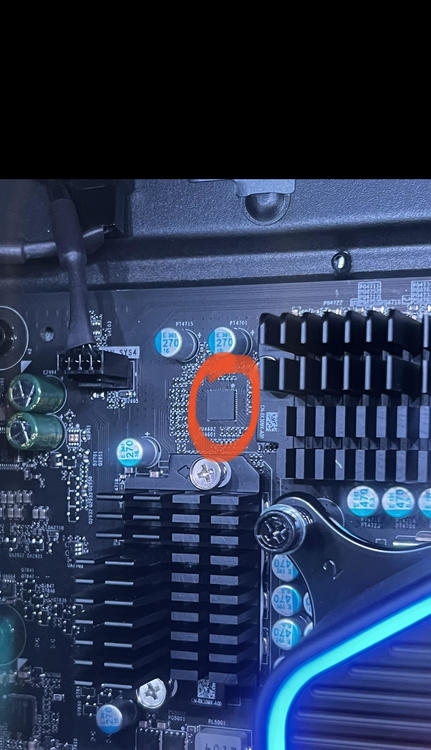

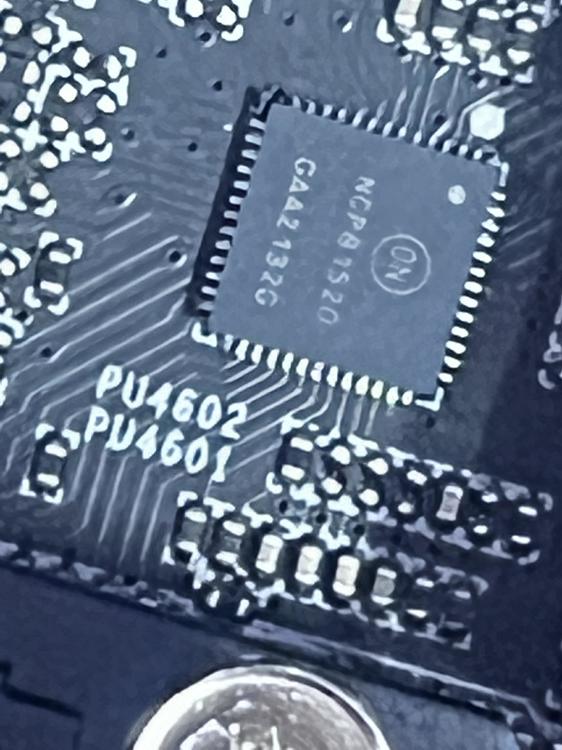

Genau, das Mainboard hat eben keine ATX Maße und entsprechend sind Bohrungen und Dimensionen anders. selbst Anschlüsse der Stromversorgung sind eigenes Design. also müsste im fall eines Wechsels hier auch ein neues Netzteil eingeplant werden. Dann kann man besser bei dem bleiben, dass man hat. währe ein €-Grab. Der Controller Chip für die Spannungsversorgung ist ein "ON NCP81520" zu dem bekommt man nur relativ wenige infos. Mein Chinesisch ist aber auch nicht gerade das beste. du findest Ihn in der Ecke zwischen den Kühlern der CPU Stomversorgung. Ich habe ein kleines Video gemacht zum Thema Auspacken, erste Eindrücke und den Umbau der Lüfter.5 Punkte

-

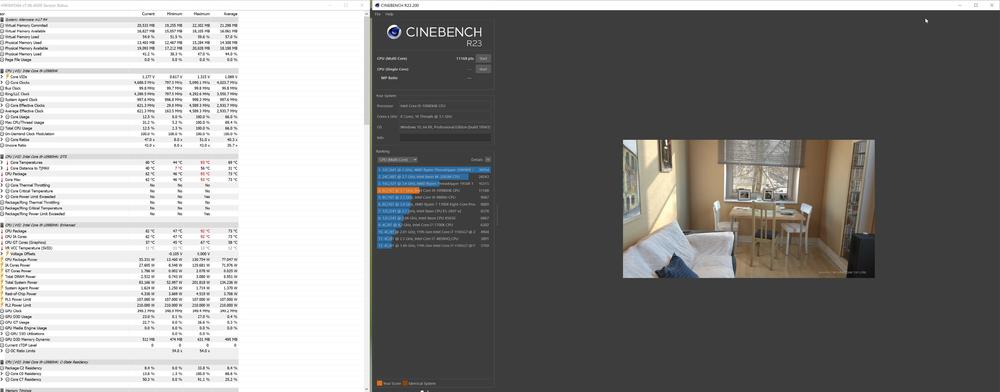

Hey, mein Rechner ist jetzt da aber ich lag lange mit einer Blöden Corona Infektion Flach. Ich habe den Rechner aber schon aufgebaut und habe ihn hier und da schon getestet. bevor er in betrieb genommen wurde, habe ich die Gehäuselüfter entfernt und sie gegen Noctua NF-A 12X25 ersetzt. Die sind echt sehr leise. Einzig der Lüfter am Radiator ist deutlich hörbar, sogar sehr deutlich. Die Pumpe selbst ist angenehm leise. Zu den ersten Ergebnissen. 3DMark Time Spy 18.954 P. CineBench R23 Multi 25.581 P. im geschlossenem Gehäuse und 1.856 P im Singel Die CPU Temperaturen gehen sehr schnell auf 90-93 grad im CineBench sodass ich erstmal alles Zerlegt habe und neue Wärmeleitpaste (MX4) aufgetragen habe. zumindest jetzt erreiche ich nur noch etwa 85 Grad im selben Benchmark jedoch ohne höhere Punktezahl. Zu erwarten sind wohl normalerweise etwa 27.500P im Multi. Hier Denke ich aber das Dell da einfach die Sicherheit sehr hoch geschrieben hat. Die CPU erreicht hier Maximal 231W selbst im LV2. Normalerweise ist der 12900KF auf 241W ausgelegt. Die Spannungsversorgung der CPU ist mit insgesamt 8 Phasen aber auch nicht gerade sehr gut. Reicht bestimmt aus aber Optimal sieht anders aus. Vergleichbare Boards von Asus und Co haben locker die doppelte Anzahl an Spannungswandlern. Lustig auch, dass der Spannungswandler Controller eigentlich für Notebooks verwendet wird. Ich muss mich mal mit dem Thema Manuelles OC im Bios auseinander Setzen. Die M2 SSD (2TB kommt als PCI-E 4 Version mit 4 Lanes und Schafft laut CrystalDiskMark 6513MB/s Read und 4997MB/s Write. Die Seagate Baracuda 2TB HDD schafft im Selben Test 204MB/s Read und 105MB/s Write. Zu der verbauten RTX 3090 kann man nichts sagen. Sie hat etwa die Leistung der Founders Edition jedoch lässt sich das Power Target nicht mal um einen Prozentpunkt anheben. Hier hat Dell eine Sperre eingebaut. Lustig auch das Thema RAM. Hier sind 2x 32GB DDR5 4800Mhz Cl38 verbaut. Das System begrenzt jedoch auf 4400Mhz und lässt sich auch nicht erhöhen. Die entsprechenden Funktionen im Bios sind ausgegraut oder gar nicht erst vorhanden. Der Ram selbst kommt von SK Hynix PC5 4800B. Weitere Lüfteranschlüsse sind ebenso wenig vorhanden wie zusätzliche Stromanschlüsse. Hier ist neben den beiden Stomanschlüssen für je eine HDD oben und eine SSD unten im Gehäuse, noch 2x 6+2Pin für Grafikkarten vorhanden. Jedoch bietet das Mainboard keine 2te PCI-E Schnittstelle für eine weitere Graka, noch das Gehäuse, hier ist direkt unter der RTX 3090 sofort das Netzteil zu finden. Ich erwarte heute noch eine Lieferung eines 92mm Noctua Lüfters (Noctua NF-A9x14 HS-PWM) den ich hinten am Gehäuse anbringen will und eine Push/Pull Configuration möglich machen soll. Dafür sieht das Gehäuse entsprechende Bohrlöcher hinter dem Radiator vor und über die Klappe mit der die Graka an dem Gehäuse gesichert wird lässt sich das PWM Kabel ins Gehäuse führen. Hier werde ich einfach ein Y-Kabel verwenden und entsprechend mit dem Push-Lüfter eine Einheit Bilden. Dann werden wir mal Sehen ob sich an den Temperaturen noch etwas machen lässt. Ich bin insgesamt etwas enttäuscht vom dem Gesamtkonzept, zumal das Mainboard sich nicht wechseln lässt ohne auf das Gehäuse zu verzichten, und die Kühlung der CPU, die sich als Stinknormale 120mm AIO herausgestellt hat deutlich unterdimensioniert ist für eine 241W CPU. Hier sieht man normalerweise 100W pro 120mm Kühlfläche MAXIMAL vor. Hier hätte also normalerweise eine 360mm AIO verbaut sein müssen um die Temperaturen in den Griff zu bekommen und das wird bestimmt auch einer der Gründe sein, warum die CPU "nur" 230W leistet und nur 8 Phasen für die Stromversorgung bekommt. Sobald die Push/Pull Configuration steht, melde ich mich wieder.5 Punkte

-

5 Punkte

-

Hab mir für's Büro ein kleines Upgrade gegönnt. Folgende Specs sind verbaut: - AMD Ryzen-5 5600G (mit iGPU) - B550i Aorus Pro AX - Scythe Big Shuriken 3 (Low-Profil Kühler) - 16GB G.Skill Trident Z (2x 8GB) @ 3.800 MHz CL16-16-16-32 (Sam B-Die) - 2x m.2 NVMe Samsung 970 EvoPlus 500GB - 400w BeQuiet Pure Power 10 (80+ Gold) (war über) - Beleuchtung: Wingboost 3 aRGB Lüfter & Phantkes Halo für PSU - Zweckentfremdetes offenes DIY-Case Da ich die Hardware gerne sichtbar haben wollte, habe ich diesmal ein bewegliches und offenes DIY-Case gebastelt. Anfangs wollte ich ein Testbench (für ITX) oder sowas ähnliches holen, aber das fand ich einfach viel zu teuer. Das DIY-Case hat mich nur 28 € und wenig Bastel-Zeit gekostet. Das "Gehäuse" kann man ganz nach seinem Belieben einstellen, da die Scharniere alle beweglich sind: Ein wenig RGB durfte auch nicht fehlen, weswegen der Wingboost Lüfter noch oben drauf kam und ins Netzteil habe ich ein Halo-Ring verbaut. Normalerweise gehören die oben drauf, aber das sah bisschen unschön aus. Die Temperaturen sind natürlich Top und der 5600G ist wirklich fix unterwegs. Also die neuen APUs von AMD sind schon nicht übel. Wenn man Lust hat, könnte man eine GPU anschließen und hätte direkt ein fertiges Gaming-Rig.5 Punkte

-

Hallo zusammen, nachdem die X17 Serie nun da ist wollte ich meine Erfahrungen und Updates geben wie es um den m17 R4 aktuell bei mir steht. Man landet ja bei der Suche nach 17 Zoll Gaming-Notebooks oft auch hier. Ich nutze den i9 und die RTX 3070 (beide Chips mit LM Repaste). Zusätzlich habe ich über den AGA Port eine 6900XT dran hängen seit ein paar Monaten und nutze ihn nahezu immer. Hier aktuelle Werte von Cinebench R23 und AWCC Fusion Custome Curve und Cinebench R23 mit Höchstleistung und TimeSpy mit AGA: Nachdem ich den AGA komplett auseinander genommen habe steckt der AGA aktuell in einem ITX Gehäuse inkl. einem PCIE16x Riserkabel ohne nennenswerten Performanceverlust. Da kommt bald ein kleines Projekt bei mir, in dem ich den AGA in einen Kasten stecken möchte um das Laptop oben drauf stellen zu können. Dann bin ich etwas mobiler. Das ITX Gehäuse ist viel zu dick für das, was SFX und Graka benötigen. Zusätzlich will ich 3 Noctua Lüfter verbauen damit ich einen AGA + Notebook-Kühler habe. Gerade wegen dem AGA ist der m17 mein Laptop geblieben. Ausreichend Power für unterwegs und eine geniale Option mit viel Power für zu Hause durch den AGA. AMD Radeon RX 6900 XT Grafikkarten Benchmark Resultat - Intel Core i9-10980HK Processor,Alienware Alienware m17 R4.pdf5 Punkte

-

Hier mal das Win11 ISO + Workaround, so dass ihr es auf den meisten Systemen zum Laufen bekommt.5 Punkte

-

@hysterix und @Nuestra Ihr wurdet von mehreren Usern bereits mehrfach gebeten, eure persönlichen Differenzen außerhalb der öffentlich einsehbaren Themen auszutragen. Dies ist eine offizielle, noch freundliche, Verwarnung. Wenn ihr eure Off-Topic Streitigkeiten nicht augenblicklich beilegt, werdet ihr aus disziplinarischen Gründen mit einer zeitlichen Postingsperre belegt, die sich bei weiterer Missachtung potenzieren wird.5 Punkte

-

5 Punkte

-

Kleiner Tipp an alle m18 Besitzer. Ich hatte minimalstes Lightbleed in der oberen linken Ecke. Hier könnte ihr selbst Hand anlegen und die vordere schwarze Plastikblende mit etwas Fingerspitzengefühl an der betroffenen Stelle anheben. Es sollten sich ein paar Clips lösen. Danach einfach etwas sanfter wieder reindrücken. Nun ist mein Bleeding zu 100% verschwunden. Oftmals kommen kleinere Lichthöfe nur zustande wenn ein Druck auf das Display ausgeübt wird. In diesem Fall war ein Clip "zu fest". 1 Minute Arbeit und ich muss nicht ständig mehr in die Ecke schauen ^^ Ich benutze übrigens immer diesen Test: Backlight Bleed Test Wen das nicht stört kann natürlich getrost die Finger davon lassen4 Punkte

-

Also bisher habe ich nix zu meckern. Kurz mal ein Game gestartet um die Lüfter zu checken (Hogwarts Legacy), zumindest klingen sie sauber - also kein pfeifen oder klackern oder so. Sie laden aber auch dazu ein, Kopfhörer zu tragen 🤣 Verarbeitung und erster Eindruck beim auspacken ist ja eh einfach mal nur richtig gut 😊 Den externen aw-Bildschirm habe ich noch nicht angeschlossen (noch nicht mal aufgestellt…), schaue jetzt erst mal nach Updates, installiere steam etc … und hoffe ich bleibe verschont von bösen Überraschungen 😅4 Punkte

-

Mittlerweile denke ich das auch, da laut Berichten jedes m18 davon betroffen sein soll. Das wäre schon krasser Zufall, wenn es bei allen immer nur 1 Core wäre. Wenn die WLP nicht richtig drauf wäre, dann sollten mehrere Cores betroffen sein. Einen einzelnen Core zu isolieren wäre ziemlich unrealistisch.4 Punkte

-

Hab meins bekommen und er bleibt. Übertakten im Bios ist freigeschaltet. Das SFF Netzteil ist dabei. AWCC lässt mich Custom Einstellungen machen Undervolt wird angezeigt aber funktioniert mit dem CC (auf den ersten Blick nicht) nicht. Ist aber eigentlich bei allen mit aktuellem Bios so. XTU oder TS habe ich noch nicht probiert. Ich bekomme im Custom Mode CB über 30k und im Balanced Mode 28xxx. Da sind die Maxtemps bei 90 und der Lüfter nicht störend. Das ist eh mein Standartmodus. Time Spy im balanced ist bei knapp 19k. Die Tests sind für euch eh nicht aussagekräftig da ich nur eine 4080 habe und meine ganzen Programme schon installiert sind. Vom Virenscanner angefangen, über VPN bis zur Citrix Workbench. Fühlt sich deutlich wertiger an als mein 17R5 oder das alte 18ner. Ich bin sehr zufrieden.4 Punkte

-

Die sind Super leise. Nur der kleine Lüfter, der die Ram kühlt fiept ab und zu. Auch unter Vollast, man hört nur ein dumpfes Rauschen. Also das ist echt gut. Ja, das bekommt eigentlich jeder hin. Falls nicht, hast du hier lauter nette Leute die dir helfen4 Punkte

-

4 Punkte

-

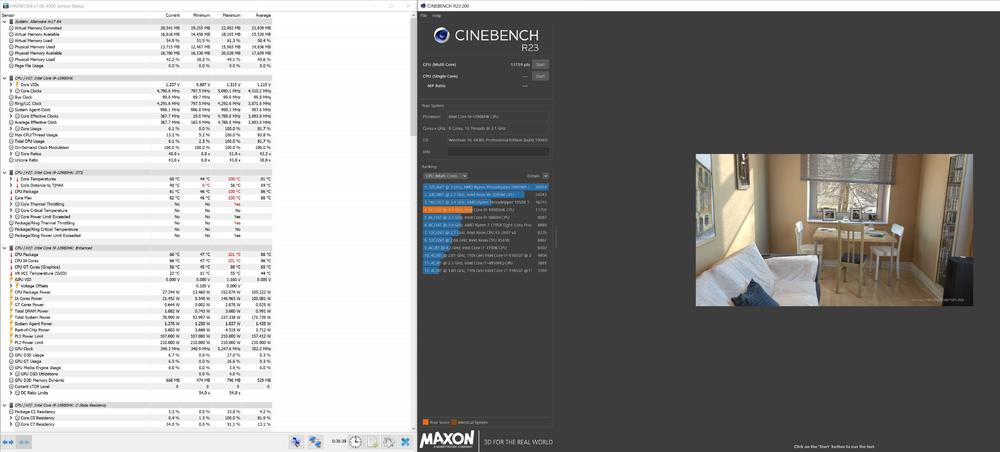

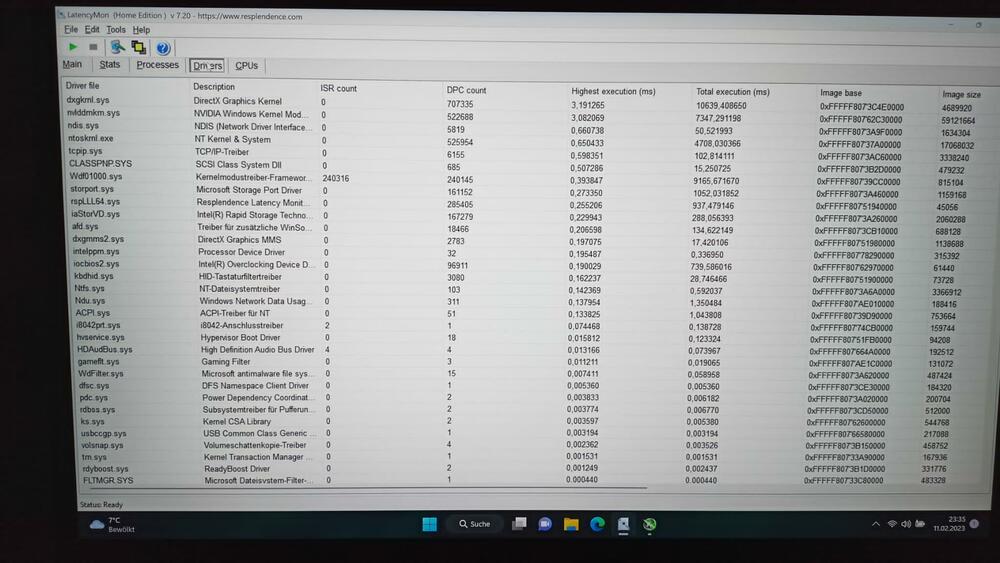

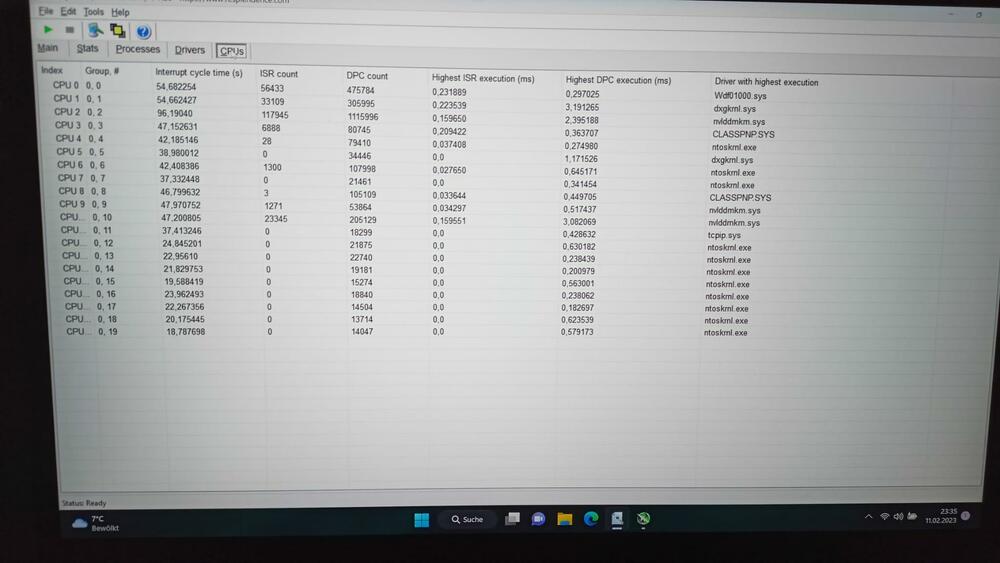

Also mal ein Update für alle... Unter Linux war es schlimmer. Es gab ein Ruckeln und auch Tearing & Ghosting allein bei 4k Videos. Daher liegt hier nun doch der Verdacht auf dem OS/Treibern. Wir haben nun noch folgendes getestet: - GameDVR via Registry deaktiviert > Keine Besserung - Intel Treiber auf aktuellen Stand gezogen > Keine Besserung -Energieoptionen auf maximale Performance gesetzt > keine Besserung - Schnellstart von Windows deaktiviert > keine Besserung LatencyMon installiert um zu sehen wo der Fehler grob zu finden ist. Im YouTube 4k Test dann Probleme erkannt durch LatencyMon mit den nVidia Treibern (über 1,x ms Drops) - nVidia Treiber komplett aktualisiert / neu installiert > Keine Besserung - Optimus im BIOS wieder aktiviert und umgestellt auf nVidia only (über 2,x ms Drops) - Optimus im nVidia Treiber aktiviert (0,x ms Drops und keine Fehlermeldung durch LatencyMon - ABER trotzdem noch sichtbar - aber viel besser) Zum Test dann @SoulDarkow in zwei Spiele geschickt da es dann eh bereits Mitternacht war und bei Spielen ist die Last ja höher. Daher nochmal LatencyMon mit zwei Spielen zur Auswertung geschickt. Hier schlug es nun wieder an. Drivers: - dxgkrnl.sys (DirectX) mit 3,191265 ms - nvlddmkm.sys mit 3,082069 ms Unter CPU deutet sich das selbe an. Könnt ihr in den angehängten Screenshots sehen. Was sind unsere nächsten Schritte?: - ich schreibe ein PowerShell Script das Windows 10/11 Home in die Registry die Treiber Updates via Windows Update verbietet (danke für den Tipp nochmal ) - das hat bei einem XPS15 wohl auch bereits lt. Dell Community geholfen da die Thermal Framework Treiber fehlerhaft sind. - wir setzen Windows 11 komplett auf Werkseinstellung zurück um den OEM Stand zu haben - Einrichtung ohne WLAN/LAN Verbindung, PowerShell Script ausführen für die Registry, Reboot und dann erst Netzwerkanbindung Ich vermute tatsächlich, es handelt sich um ein "Kaputt Konfiguriertes" Windows durch die Treiber Updates selbst. Diese sind aber per Default eben leider in Windows aktiviert. Wir geben euch wieder Rückmeldung sobald wir neue Infos hierzu haben Viele Grüße, Michael4 Punkte

-

4 Punkte

-

4 Punkte

-

4 Punkte

-

Da ich es für den Preis niemals behalten würde (benötige auch keine 64 GB Ram und 4 TB SSD), kann ich es leider nicht bestellen (weil ich nur Sachen bestelle, wo auch die Chance besteht, es zu behalten. Sonst ist es wohl bisschen unsozial ^^).4 Punkte

-

Nächste Woche ist auf meinem Hobbykonto hoffentlich Ebbe weil ich endlich ein m18 bestellen konnte 😂4 Punkte

-

Sein Geheimnis liegt darin daß er nie aufhört nach News zu schauen 😎4 Punkte

-

wir werden es sehen. Lieber wäre es mir trotzdem das die GPU immer und unabhängig von der CPU ihre 175w nutzen darf und das auch die CPU immer und unabhängig von der GPU ihr volles Powerlimit nutzen darf. Ich mag so dynamischen Mist einfach nicht. Das dient nur als Ausrede für zu schwache Kühlung. Nichts anderes. Sicher wird das m18 mit 250w gut performen, das steht außer Frage.4 Punkte

-

Meinen A51mR2 behalte ich eigentlich nur aus dem Grund das er noch kompromisslos auf Performance getrimmt ist. Es ist das letzte echte DTR. Ich glaube nicht das Dell den kompromisslosen Weg gehen wird. Ich tippe: - 13900HX mit hohem Powerlimit - 4080Ti mit 175w - Unified Heatsink ohne echte Vapor Chamber und zu schwach ausgelegte Kühlung so das 150w GPU und 60w CPU unter Last gleichzeitig das Limit sein werden und damit die Hohen Powerlimits witzlos Gehäuse zu dünn für vernünftige Lüfter und damit wieder Hochfrequente Störgeräusche - schöne dünne Ränder das die 18 Zoll eher einen Footprint von früheren 17 Zoll haben. - wie immer schickes Design - frecher Preis (5k+ Liste) Ich freue mich über jeden Punkt wo ich falsch liege4 Punkte

-

4 Punkte

-

Ich wollte nochmal im Bezug auf mein Legion 7 ein kurzes Update posten, denn mittlerweile bin ich mit dem Notebook an einen Punkt angekommen, wo ich problemlos auf idle-Fanspeed zocken kann, was schon von der Lautstärke her Desktop-Niveau hat. Der Grund dafür ist, dass man das Notebook (noch) relativ gut modden kann und Faktoren wie nicht-invertierte Heatsink das begünstigen. Mein LM (Conductonaut) habe ich mittlerweile wieder aus dem Gerät entfernt und gegen Honeywell 7950 ersetzt, welches ähnlich gut performt. Insgesamt zwar 2-3°C schlechter, dafür aber sehr langlebig, nicht korrosiv und nicht elektrisch leitend, also relativ stressfrei. Schon ziemlich krass, wenn bedenkt, dass es ich um normale Wärmeleitpaste bzw. Pads handelt. Da ich mit dem Gerät keine Temperaturprobleme habe, ist mir die Langlebigkeit und Zuverlässigkeit weitaus wichtiger. Dann habe ich, wie auch für alle meine anderen Notebooks, einen U2-Kühler mit Noctua-Lüftern gebaut, der dank der gut erreichbaren Vapor-Chamber-Heatsink diese effektiv kühlen kann. So sieht das Teil aus: Dann habe ich mir noch vor kurzem noch den Heatsink-Mod eingebaut und die Bodenplatte ein wenig bearbeitet, die aus meiner Sicht die Schwachstelle vom L7 ist. Die Belüftungslöcher sind mMn etwas zu klein und bremsen zu viel Luftstrom aus, selbst mit Kühler. Deshalb habe ich die Löcher auf von 0,8mm auf 1,5mm, sprich fast die doppelte Größe, aufgebohrt. Eigentlich ist genug Kühlleistung vorhanden, aber irgendwo will man ja doch so wenig Lüftergeräusche wie möglich und trotzdem gute Temperaturen. Außerdem macht mir das basteln und verbessern Spaß. (Der HS-Mod ist nicht höher als die Füße und stört somit nicht. Man kann das Notebook nach wie vor flach auf den Tisch stellen) Mit den Mods inkl. des Noctua-Kühlers braucht man dann nur noch sehr wenig Kühlleistung. 34% Lüftergeschwindigkeit ist der idle-Fanspeed. Hier mal ein 30-minütiger Gaming-Log (rein ingame, ohne Verfälschung von idle-Werten) mit FarCry 6 und dauerhaft festgesetzten 36% Fanspeed: 2% weniger Fanspeed macht in den Temperaturen kaum noch was aus. GPU läuft undervoltet im Gaming-Profil auf 1.845 MHz @ 825mV.4 Punkte

-

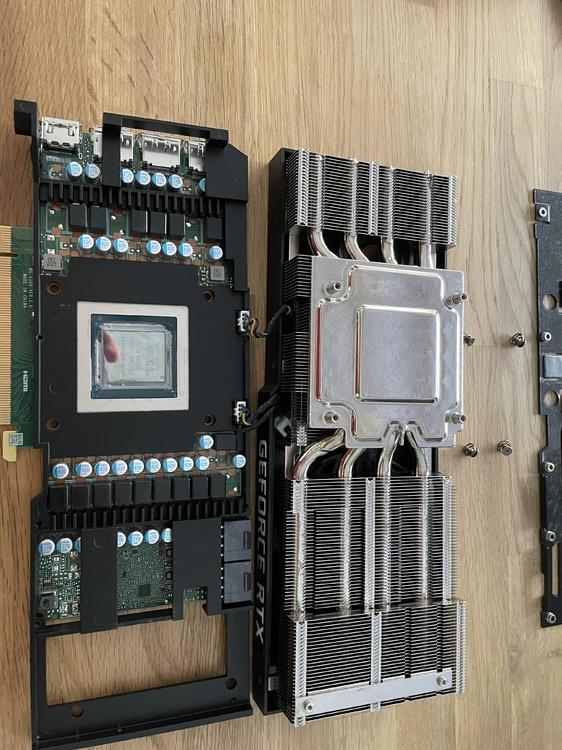

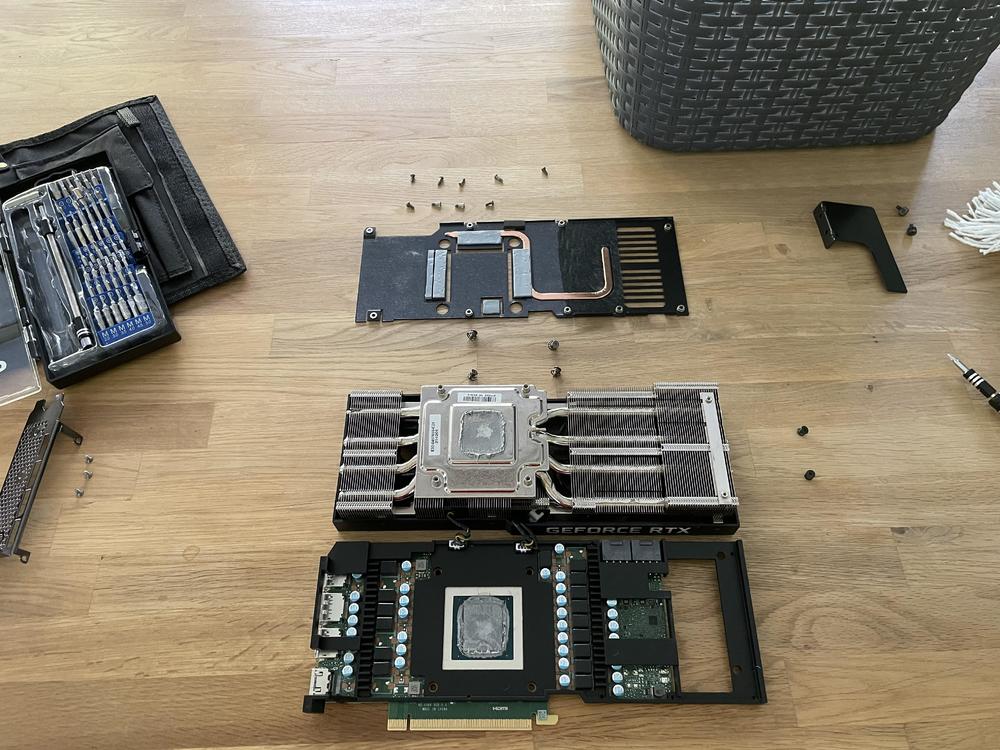

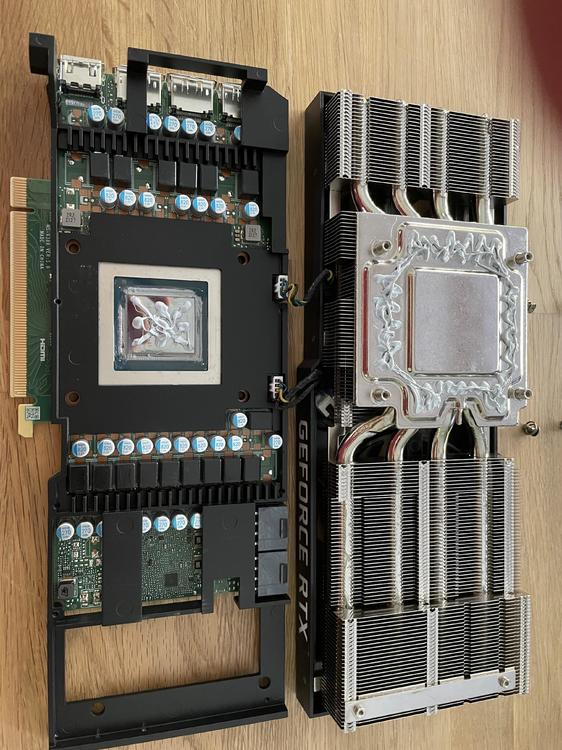

Hallo zusammen Ich habe es getan, auch wenn mich viele dafür belächeln werden. Ich habe meine Strix 3090 unter Wsser gesetzt. Da ich mir keinen Custom Loop bauen wollte bin ich den alternativen Weg gegangen und habe eine Alphacool AIO verwendet. Ich bin mit dem Ergebnis sehr zufrieden und die Temps sind deutlich besser als zuvor. Jetzt erreicht die GPU unter Vollast nicht mehr als 54° Grad. Die Regenbogen RGB verwende ich eigentlich nie sondern nur weisse RGB. Hatte aber kein anderes Bild. Grüsse aus der Schweiz4 Punkte

-

4 Punkte

-

Gestern ist das neue Razer Blade 17 mit 12800H und 3070 Ti gekommen: FarCry6, FHD, hohe Details, Stadt-Savegame, bei keinem Device ein GPU-Limit, also CPU-/Ram-Limit: Lenovo Legion 7: 84 fps (ca. 40w) Alienware Area 51m R2: 94 fps (ca. 75w) Razer Blade 17: 102 fps (ca. 60w - edit: aber nur 2 Minuten, danach 45w und deutlich weniger fps) Desktop: 108 fps (ca. 115w) Mit Ausnahme vom Razer Blade 17 können alle leise und gleichzeitig ohne Throttling betrieben werden. Aber: Der 10900k vom Area 51m R2 läuft mit 4,5 GHz auf allen 10 Kernen (statt 4,9 GHz), weil der gute alte 10nm-Dinosaurier sonst einfach zu viel frisst. Normal liefert er also noch einige fps mehr, aber das sollte man dann ja fairerweise nicht berücksichtigen, da man ihn so nicht leise ohne Throttling betreiben könnte. Alle anderen CPUs sind stock. Der Vergleich ist so aber fair. Fair wäre es nur nicht, wenn der 10900k ein Undevolting hätte, ohne dass er weniger Takt hätte. Die Hardware-Details sind wie folgt: Lenovo Legion 7: 5800H, 3200 CL18 Alienware Area 51m R2: 10900k, 2933 CL16 Razer Blade 17: 12800H, 4800 CL40 Desktop: 5900X, 3600 CL16 Alle haben 32 GB Dual Channel und Dual Ranked. Ausnahme Razer: 16 GB Quad Channel. Alle Daten über CPU-Z ausgelesen, neuste Beta-Version. Alle werden mit Windows 11 und neustem GPU-Treiber betrieben. Die 12. Intel Gen ist definitiv - leistungstechnisch - beeindruckend (edit: Problematisch ist aber, wenn ein Notebook dauerhaft (PL2) nicht mehr als 45w zulässt). Aber das Razer Blade 17 an sich ist wie erwartet für mich eher enttäuschend: Bei 2400 RPM (man kann die Lüfter tatsächlich über die Razer-Software im Profil "Ausgeglichen" fixieren) ist es weder leiser, noch angenehmer, noch kühlt es die CPU bei 35w (mehr geht in diesem Modus nicht) besser als im kleineren 16er Lenovo bei 2400 RPM. Die Lüfter sind definitiv hochfrequenter. Auch wenn ich die Lüfter automatisch steuern lasse (lauter) bleibt es im Profil "Ausgeglichen" bei 35w. Dieses geringe Limit führt dazu, dass man beispielsweise im oben genannten Farcry 6 City-Savegame von knapp 100 fps auf ca. 75 fps runterfällt (weil der Durchschnitts-Takt auf allen Kernen auf etwa 2,5 GHz sinkt). Das benutzerdefinierte Leistungs-Profil, was mehr TDP und somit Takt zulässt, ist deutlich lauter und von den Lüftern überhaupt nicht beeinflussbar. Wie gesagt sind 35w für viele Games / Szenen zu wenig (FC6 nimmt sich nicht mal viel, da gibt es ganz andere Spiele), und höhere TPDs benötigen höhere Lüfterstufen (Razer) oder throtteln halt (bei dünnen Notebooks, wo man die Lüfter 100% steuern kann, sei es durch ein Tool oder Bios-Hack). Der 5800H vom Lenovo Legion 7 benötigt so gut wie nie mehr als 35w beim Gaming, er schafft aber natürlich auch weniger fps im CPU-/Ram-Limit als ein (leicht gezügelter) 10900K im Area 51m R2 oder ein 12800H im Blade 17. Das muss man natürlich ganz klar dazu sagen. Allerdings ist ein 12800H auch viel neuer als ein 5800H und darf wiederum auch nicht verglichen werden. Was ist positiv am Razer Blade 17? Die Anmutung, Verarbeitung, Tastatur (nur neues Model), das Trackpad und Design. Aber letzteres ist fürs Gaming sogar eher nachteilig (das Bild ist deutlich tiefer als beim Area 51m R2, was ergonomisch schlechter ist. Sieht man auf den Bildern gut, die angehängt habe. Dafür ist es für den Transport natürlich besser, da dünner und leichter). Display, Akku und Sound ist mir nicht großartig was aufgefallen / habe ich auch nicht wirklich getestet. Die Tastatur ist mittlerweile deutlich besser beim Razer bzw. sehr gut eigentlich. Mich persönlich stört daran nur, dass bei 17 Zoll kein Numpad dabei ist (dadurch ist WASD usw. auch sehr weit rechts), aber das werte ich neutral, ist ja Geschmackssache. Unterm Strich werde ich es also wieder retournieren. Das (ebenfalls dünne) Alienware x17 R2 könnte interessanter für mich sein, da sich dort die Lüfter schöner anhören sollen. Jedoch wird auch hier sehr sehr sicher die CPU auf 35w im Silent-Modus beschränkt, und das ist wie gesagt einfach nicht genug und alles andere ist mir dann zu laut. Ein Lenovo Legion 7, selbst mit dem Fan Control Tool, würde mir mit 12. Gen (kommt auch dafür) leider auch nichts bringen, da bei 2300 RPM und über 35w Throttling beginnen würde (was ja physikalisch einfach logisch ist). Zudem gibt es kein Legion 7 (Alu, Vapor Chamber usw.) in 17,3 Zoll. Es muss für mich also schon wieder (😁) beim korpulenteren Area 51m R2 bleiben, weil dieses einfach in der Lage ist, mit deutlich mehr als 35w im Silent-Modus betrieben werden zu können. Und das auch völlig original, ohne Tool oder so (obwohl mir persönlich das egal wäre). Irgendwann werde auch ich auf ein dünnes Gaming-Notebook gehen können, und zwar dann, wenn mir 35w die gewünschte Leistung geben können. Derzeit benötigt man noch ca. 60w mit der Intel 12. Gen. Das hört sich ja nicht viel mehr an, für ein dünnes Notebook ist es das aber. Die neuen AMD Chips gehen hier in die richtige Richtung! Ich weiß aber nicht, was ich machen würde, wenn wieder ein DTR wie das Area 51m kommen würde, mit Intel Gen 12 Desktop-CPU oder von mir aus auch 12900HK, welche man dann jeweils mit ziemlich hohem Takt im Silent-Profil betreiben könnte... ich glaube ihr wisst was ich wohl kaufen würde... In Verbindung mit dem neuen DSR 2,25x und dem neuen kleinen 330w-Netzteil (besorge ich mir definitiv) macht das Area 51m R2 glücklicherweise (wieder) viel Spaß. Transportieren tu ich es so gut wie gar nicht (fast ausschließlich für Couch/Co-Op), das hilft natürlich. Alle die was Kompakteres brauchen oder bevorzugen, müssen dann eben mit lauteren Lüftern leben, da sie sonst zu beschränkt werden, sei es durch TDP-Limit oder Throttling. Für die allermeisten aufgrund von Headset-Nutzung wohl aber weniger ein Problem. Wenn man das kann, ist es beindruckend, was ein solches dünnes (Razer) 17 Zoll Notebook mit dem 12800H leistet. Im Farcry 6 CPU-/RAM-Limit reden wir hier fast von 5900x-Desktop-Niveau! Abschließend noch drei Bilder vom Blade 17 und Area 51m R2. Ich habe beide so positioniert, dass die Bildschirme auf der gleichen Höhe/Tiefe sind (auch wenn es teilweise auf den Fotos so nicht richtig rüberkommt). Falls euch die Bilder zu dunkel vorkommen: ich musste vom iPhone die Belichtung um ca. die Hälfte reduzieren, damit die "Farben" der beiden Notebooks realitätsnäher rüberkommen. edit: Die CPU fällt bereits nach 2 Minuten von ca. 60W (bei FC6) auf 45W, selbst im höchsten Leistungsmodus. Ob man das irgendwie umgehen kann, muss jemand anderes rausfinden. Ich wollte jetzt nicht mehr viel Zeit in so eine laute Kiste stecken. Zweitens: im Modus "Ausgeglichen" (dort kann man ja die Lüfter fixieren) wird nicht auf 45w gedrosselt, sondern auf 35w. Hab alles entsprechend editiert.4 Punkte

-

Nun ich Denke A und B aber keine bösen Absichten, na ich weis nicht... Habe mir immer Alienwarerechner zugelegt halt wegen der Leistung , stabielem Gehäuse, Tastaturbeleuchtung, usw... aber heute ist das alles nichts besonderes mehr. Da erwarte ich von Alienware etwas mehr als: - Billiges Lackiertes Alienwarelogo (unbeleuchtet) - Farbe nur in "weiss" wenn man eine deutsche Tastatur will (Habe mich drauf eingelassen aber ich mag es nicht, wird eh gelb und schmuddelig aussehen in einem Jahr) - Ein Alienwarelogo das besser nicht beleuchtet wäre so schwul wie das in weiss aussieht. - Die neusten Modelle ohne Ziffernblock (geht garnicht) und ich vermisse schon jetzt die Makrotasten. Muss ich das ernsthaft ne externe Tastatur dranmachen??? - Alles immer dünner , wer findet das den cool bei einem Rechner wo man brachiale Leistung erwartet? - Leistung im Bios schon limitiert. Wozu ein Alienware kaufen, wenn die Konkurenz schnellere Rechner baut? - Warum ist man denn genötigt die Kisten aufzuschrauben und erstmal in Ordnung zu bringen. (Repast und so...) - Dell will Alienware nicht. Nicht im eigenen Hause und auch nicht als Konkurenz... - Alles billig billig, nicht für uns Kunden, ne ne. Mal beim Support angerufen? Da hat man dann eine Mitarbeiterin in Slowenien drann im Home Office... Die kriegen nicht mal raus, wer, bzw. welche Abteilung, bei denen eine Rechnung schreibt! Jetzt kein Witz! - Glaube nicht das in Zukunft noch was von Alienware zu erwarten ist. Inovation bestimmt nicht, Vorreiter niemals. Die Zeiten sind vorbei. Bei der "neuen" Führung ist das nicht zu erwarten.4 Punkte

-

Vielen Dank von mir an die mutigen Erstkäufer, die hier ihre Erfahrungen mit dem R13 in verschiedenen Konfigurationen kund getan haben bzw. aktuell noch tun. Es ist sehr schade, dass Dell/AW offensichtlich auch aus diesem Gerät nichts vernünftiges gemacht hat. Ich hatte große Hoffnung in den R13 gesetzt, wenn ich das aber alles hier lese werden jegliche Hoffnungen zerstört und das Gerät ist bei mir als eventuelle Kaufoption definitiv raus. Sorry Dell/AW, aber so geht es nicht, zumindest nicht für das Geld, was dieses Gerät in einer dementsprechenden Ausstattung letztendlich kostet. Wir alle müssen/wollen Geld verdienen, das ist klar, aber dafür muss auch eine Leistung erbracht werden, mit der ein Geldgeber zufrieden ist. @The_Mistral: Mal im ernst, hattest du wirklich etwas anderes erwartet ? Das ist in der Tat sehr zum totlachen, ja, denn wenn die Cryotech-Kühlung als "höherwertigere" Kühllösung beim R13 nicht ausreicht, welche bitteschön reicht denn dann aus???? Manchmal weiß man da echt nicht, ob man als Kunde nach Strich und Faden verarscht wird, oder ob der Ansprechpartner, mit dem man in Kontakt steht, tatsächlich gar keine Ahnung hat und somit auch keine böse Absichten vorhanden sind. Gruß Jörg4 Punkte

-

Hallo Zusammen, Ich biete den X17 hier schon mal an, da ich definitiv beim Area 51m bleiben werde. Zustand ist absolut neuwertig, ist ja nur ne Hand voll Stunden gelaufen. Verbaut ist: I9 11980HK RTX3080 32GB XMP Ram 120Hz UHD Display 3 Jahre Premium Plus Vor Ort Service Temperaturen sind gut, kein Bleed und keine Pixelfehler. Wer also kein Lotto nach einem guten Gerät spielen will, kann hier zuschlagen. Abgeholt werden kann in 02625. Abholung wird absolut bevorzugt. Ich würde das Notebook zum Selbstkostenpreis weiter geben um den guten Preis nicht zu verschenken. Geht er dafür nicht weg, bekommt ihn Dell zurück. Auf der Rechnung stehen 3611€. Das ist auch der Festpreis. Listenpreis aktuell 4500€.4 Punkte

-

Wenn er im Forum in gute Hände kommt will ich auch kein Gewinn machen. +-0 reicht aus. Dafür bekommt jemand ein mit Adleraugen geprüftes Notebook. 😁 Und wer hier öfter mitliest weiß das das kein Witz ist 😅🧐4 Punkte

-

https://www.dell.com/support/home/de-de/product-support/product/alienware-m17x-r3/drivers4 Punkte

-

Das area51m ist auch ein Gerät von alienware und hier ist ein alienware forum wo es hauptsächlich um alienware geht4 Punkte

-

Also keinen Screenshot für uns, schade wäre interessant gewesen Ich persönlich glaube nicht, dass das eine Sache für den technischen Support ist. Letztendlich werden ja Signale übermittelt, nur später als wenn nur via HDMI angeschlossen. Tippe ehrlich gesagt eher auf ausstehende Patches. Soweit ich weiß hatten schon vor Jahren viele User, mMn vor allem welche mit einer Setupkombination AMD-Prozessoren/Boards und Nvidia Grafikarten, genau dieses Phänomen; bei Nutzung des Displayports zeigte sich Bildschirmaktivität erst nach Start von Windows, mit HDMI-Anschluss bereits vorher. Daraufhin bot Nvidia ein Tool an, das die Kompatibilität der Pascal Grafikkarten (10xx und Titan) mit den Displayport Standards 1.3 und 1.4 herstellte, nachdem es überprüft hat, ob ein Firmwareupdate für einen Teil vom VBIOS, das UEFI GOP (graphics output protocol), notwendig ist (*Link weiter unten). In der Erläuterung dazu hieß es: "Without the update, systems that are connected to a DisplayPort 1.3 / 1.4 monitor could experience blank screens on boot until the OS loads, .....". Das Zusammenspiel der Hardwarekomponenten während der Bootphase wird doch durch deren Firmware bestimmt, hier also also in erster Linie Mainboard, Graka, Monitor und das Kabel. Vorausgesetzt, dass all diese Geräte und die betreffenden Anschlüsse nicht defekt sind, können im Prinzip doch nur fehlende oder unzureichende Patches oder Designfehler dazu führen, dass sich das Setup mit Anschluss via Displayport allein anders verhält beim Booten als nur mit HDMI-Port. Was AMD angeht, hab ich schon vor einem Jahr Klagen darüber gehört, dass manche Chipsettreiber nicht immer und dann auch nicht richtig geupdatet werden, so zB der Installer für den I/O controller. Was das System-BIOS angeht, gab es zwar vor nur wenigen Wochen ein Update, und dann auch noch betreffend "Preboot Execution Environment" für Windows, aber wer weiß, ob sich da nicht etwas eher "verschlimmbessert" hat. Allerdings, wenn Du damit argumentierst, dass die Geräte erst 2 Monate alt sind, gehst Du ja wohl von einem Hardwareproblem aus. Falls Du Dich deshalb an Support wenden möchtest, wirst Du vielleicht mit nachstehenden Fragen konfrontiert, die wie hier sonst auch durchgegangen wären: Möglichkeit zuvor noch ein anderes Kabel zu testen oder Monitor mit DP Kabel an einen anderen PC anzuschließen? Über ePSA-Test hast Du auch keinen Hinweis irgendeinen Hinweis auf Mängel? BIOS Einstellungen im BIOS je geändert oder aktuell (vor Neustart nur mit Displayportanschluss) auf "default" gestellt, also auf Werkeinstellungen? CMOS-Einstellungen gelöscht per Jumper wie im Servicemanual beschrieben? Dann wäre die letzte bekannte/gespeicherte Systemkonfiguration gelöscht und Du könntest direkt mit solo Displayportanschluss System neu starten. und last but not least, wird man Dich womöglich auch noch bitten, Daten zu sichern und Windows neueste Version auf Basis aktueller Treiber und BIOS erneut zu installieren. Nun, Deine Entscheidung was besser ist, auf sinnvolle Patches in naher Zukunft zu hoffen, sei es von Nvidia oder AMD oder Dell, oder wegen der "Unannehmlichkeit" den Bootbildschirm via Dp nicht zu sehen zu bekommen, nun den Supportapparat in Gang zu setzen. Man geht ja auch nicht täglich ins Bootmenü und wenn nötig, könntest Du ja HDMI anschließen. So, sorry für langen Post, hab irgendwie vergessen innezuhalten^^ Viel Erfolg! *) https://www.nvidia.com/en-us/drivers/nv-uefi-update-x64/4 Punkte

-

Nach nur 6 Tagen ist gestern mein Corsair One i200 mit 11900k (werde aber AMD 5900x nehmen) und 3080 angekommen und ich bin ziemlich begeistert. Die Pumpen laufen beide mit etwas unter 2000 RPM und der große Lüfter oben, welcher die warme Luft raustransportiert, läuft mit bis zu knapp 1500 RPM. Die Rede ist von Gaming unter Volllast (ohne Undervolting). Mit UV bei +100 MHz Core (geht sicher noch mehr - je nach Chip halt), + 500 MHz Memory und einem 0,9v cap (bei dieser Spannung erreichen ja viele Chips stabil in etwa die stock-perfomance) laufen die beiden GPU-Lüfter, die dann eben erst später anspringen, auf 1500-1900 RPM, je nachdem wie lastig das Spiel ist bzw. welche Engine genutzt wird. Die UE4 Engine ist z.B. nochmal fordernder als die meisten anderen. Bei dieser können dann auch knapp 2300 RPM bei einem der beiden GPU-Lüfter und bis zu 69 Grad anliegen. Dort werden die 320W auf der GPU dann eben schon bei 0,8XXv erreicht. Bei anderen Spielen wird für 0,9v nur 220W gebraucht..., aber das sollte ja bekannt sein. Je nach Spiel / Engine / Last dreht der große Lüfter oben auch nur mit z.B. 1300 RPM statt mit bis zu 1500 RPM (im Auslieferungszustand bzw. mit dem Standard-Profil). Wer sein Spiel cappt und es so eingestellt, dass dieses fps-cap überwiegend gehalten werden kann, der wird wie immer (neben stabileren frametimes) mit besseren Temperaturen und/oder geringerer Lautstärke belohnt. Die GPU-Temperatur bewegt sich bei den meisten Spielen mit dem 0,9er cap zwischen 60 und 65 Grad. Die CPU-Temperatur ist ebenfalls ähnlich. Unterm Strich ist der Rechner leiser und kleiner als gedacht. Und auch toll verarbeitet - ein tolles Stück Hardware! Natürlich hört er sich dabei sehr rauschig an, nochmal deutlich rauschiger als das Alienware Area 51m, welches zumindest für ein Laptop, ja auch schon sehr rauschig ist. Natürlich ist der Corsair PC insgesamt auch leiser als das Area 51m mit dem Standard-Silent-Profil (2500/2300 RPM). Mit dem 0,9ver cap ist der Corsair-PC ungefähr so laut wie das Area 51m mit ca. 2100 RPM (aber natürlich viel kühler und wie schon gesagt eben auch rauschiger). Bei wenig Last hört man ein leises Gurgeln, was bei Last dann aber nicht mehr hörbar ist. Da ich den PC eh nur für Gaming nutze stört mich das nicht. Möglicherweise ist auch etwas Luft im System. Ich habe soeben zwei (benötige für zwei Häuser jeweils einen) mit 5900x und 3080 bestellt und freue mich mit diesen meine UHD-Monitore sowie TVs besser ausnutzen zu können. 😎 "Controller-Spiele" zocke ich mit 60 fps cap, und "Maus-Spiele" mit 90 fps, so schaff ich in bisher jedem Spiel UHD mit hohen Details. Die oben genannten Werte sind aber auch ohne fps-cap darstellbar bzw. in dieser range. Beide Alienware Area 51m behalte ich aber trotzdem, einer ist nach wie vor für meine Frau fürs Coop-Gaming im Couchmaster und den anderen wird nächstes Jahr mein Sohn bekommen. In einigen Jahren kann man dann alles aufeinmal verkaufen und neukaufen, da die 2080 im Area 51m in FHD natürlich nicht langsamer ist als die 3080 in UHD. Wenn man berücksichtigt, dass man bei UHD nicht so eine starke Kantenglättung (frisst viel Leistung) braucht ist die Leistung so ziemlich identisch. So macht es dann irgendwann Sinn alles auf einmal zu ersetzen und nicht schon irgendwas zwischendurch. Ich dachte ich müsste die Lüftersteuerung beim Corsair-PC selbst in die Hand nehmen - muss ich aber nicht. Es reicht einfach nur ein GPU-Undervolting durchzuführen und schon ist der PC für mich leise genug. Bei UE-Games ist er etwas lauter - quasi stock (da auch mit einem 0,9v cap hier die 320W auf der GPU erreicht werden) - aber immernoch ok. Eins kann ich sicher sagen: wohl fast alle oder alle Fertig-Systeme werden lauter (und gleichzeitig wohl auch größer) sein. Selbst mein selbstgebautes ITX-System (NR200) mit hochwertigen Noctua-Lüftern (auch auf GPU) war im Grunde nicht leiser. Ja, für dieses Konzept/Design usw. zahlt man auch ordentlich. Mir ist es das aber wert.4 Punkte

-

Hier mal ein Retro Video. Fand das echt cool zu sehen und weckt ein wenig Nostalgie was mich an Alienware immer so beeindruckt hat:4 Punkte

-

Für all die Battlefield-Fans unter Euch, 9.Juni ist der Tag, welcher! 🙂 https://www.gamestar.de/artikel/battlefield-6-reveal-datum-trailer,3370270.html4 Punkte

Diese Rangliste nutzt Berlin/GMT+02:00 als Grundlage

(3).thumb.jpg.da196ebea1c4e1312059b0ee6636d27a.jpg)

(2).thumb.jpg.52a2e0bf460bd7a7269d65d787b99283.jpg)

.thumb.jpg.2107288e209745f774c9b50fa512ca24.jpg)

.thumb.jpg.a9d8fd50c77117a43db1087c7250501e.jpg)

.thumb.jpg.36adb6fcdabf2985015b522b36093fcc.jpg)

.thumb.jpg.05d1415b6271733ff1bdb155c797477a.jpg)

.thumb.jpg.2254865c2501405b6d07a658f026b708.jpg)

.thumb.jpg.6a10efd4ac7e24ad3d77b2342ed11af6.jpg)