Community durchsuchen

Zeige Ergebnisse für die Tags "'Alle Modelle (Notebooks)'".

-

Hier nochmal ein wichtiger Hinweis für alle die Windows 11 auf Legacygeräten installieren wollen oder es schon haben. Damit das mittlerweile in die Jahre gekommene Command Center für diese Geräte reibungslos und im vollem Umfang funktioniert, ist es wichtig in den Sicherheitseinstellungen die Kernisolierung und Microsoft Sperrliste gefährdeter Treiber zu deaktivieren. Hintergrund ist der, dass das CC sehr tief ins System eingreift, also bis auf die BIOS ebene zugreift oder besser zugreifen können muss um korrekt zu funktionieren. Diese Sicherheitsfunktionen von Windows können das verhindern und somit kommt es dann zu Fehlermeldungen und/oder Funktionseinschränkungen. Dieses Verhalten habe ich bei meinen Legacygeräten auch schon erleben dürfen, aber komischerweise nicht immer und bei jedem Gerät. Durch deaktivieren dieser beiden Funktionen konnte ich dieses Problem lösen, dann allerdings auf Kosten der Sicherheit. Dieser Hinweis dient dazu, dass wenn es zu Fehlermeldungen und/oder Funktionseinschränkungen kommen sollte in vielen Fällen an diesen genannten Einstellungen liegt. Dies gilt für alle Legacynotebooks sowie allen Legacydesktops. Es gibt noch diverse Dinge mehr die es zu beachten gibt, wenn man Windows 11 auf älteren Geräten installieren möchte, die hier und da in diesen Forum schon genannt wurden. Zur besseren Übersicht kann und darf dann alles zu dem Thema Legacygeräte und Windows 11 hier rein und gefragt werden.😉

-

Hallo ich suche einen Heatsink 2fach oder 3fach für den M18XR2 im Internet kriegt man sie nur überteuert oder den falschen vom Alienware 18 wäre nett wenn ihr mir helfen könntet da ich seit Wochen einen M18XR2 restaurieren möchte in Nebula Red ich hab schon soviel Geld da rein gesteckt da die Teile echt teuer geworden sind.Mit freundlichen Grüßen Jens

-

.thumb.jpg.4024e90166344449a9704f4ff655f0eb.jpg)

Alle Modelle (Notebooks) AW Notebooks Kühlpad

Svencore erstellte Thema in Kauftipps & Entscheidungshilfen

Ich möchte jetzt nicht die große Werbetrommel rühren, aber ich habe nach langer Suche endlich ein Kühlpad gefunden welches für mich persönlich am besten passt, dies möchte ich nur mal teilen hier. Ich verdiene da nix dran, dient der reinen information. Ich bin durch Zufall drauf gestoßen als ich das Review vom Razer Kühlpad gesehen habe, welches wohl gar nicht so gut sein soll und preislich Razertypisch hoch angesiedelt ist. Es handelt sich um dieses: Es passt Designtechnisch meiner Meinung nach sehr gut und am besten zu dem Legend Design und auch zu den anderen AW Notebooks. Die Kühlleistung kann ich bestätigen, war wirklich sehr überrascht. Beim M15 R2 sehr gut und erst recht beim Area 51m R1. Das einzige was für den ein oder anderen sehr störend sein kann ist die enorme Lautstärke bei höheren Drehzahlen. Mit Headset oder zum benchen ist das Teil wirklich genial. Habe es für 135€ bei A....n erworben. Vielleicht ist das ja für den ein oder anderen auch etwas. Ich bin persönlich jedenfalls sehr zufrieden damit😉👽! -

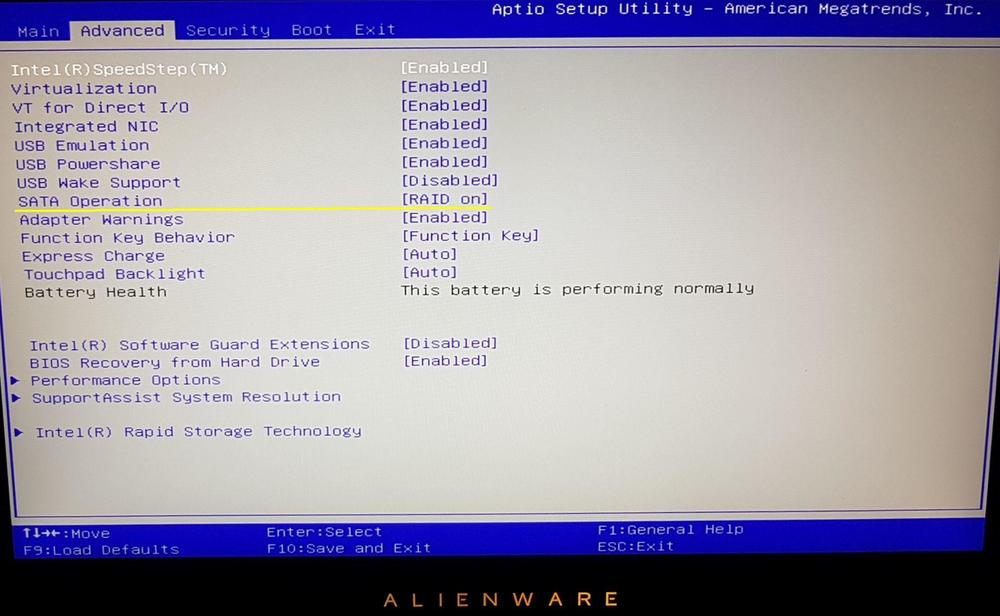

Hallo zusammen, wie würdet ihr bei einer Windows 11 Neuinstallation vorgehen. Hier meine Vorgehensweise bei einem Alienware 18 Area-51 (noch nicht durchgeführt, nur zur Information): 1. Mit dem Media Creation Tool von Microsoft einen Windows 11 USB Stick erstellen. 2. Von der Dell Support Seite alle Treiber und das Alienware Command Center für das Alienware 18 Area-51 herunterladen und ebenfalls auf einen USB Stick sichern, bis auf die 3 folgende: - NVDIA Grafikkartentreiber direkt von der NVIDIA Seite - Intel Killer Performance Suite (LAN und WLAN) direkt von der Intel Seite - Intel Bluetooth Treiber direkt von der Intel Seite Mache ich immer so, weil aktueller und LAN und WLAN Treiber in einem Paket enthalten sind. 3. Beim Start des Laptops mit der Taste F2 das Bios öffnen und unter "Storage" von RAID auf AHCI eintellen, damit Windows 11 problemlos und ohne das einbinden weiterer Treiber installiert werden kann. Achtung: Durch Veränderung dieser Einstellung, ist die Windows Installation unbrauchbar, das heißt eine Windows Neuinstallation ist danach zwingend notwendig. 4. Beim Start des Laptops mit der Taste F12 das Bootmenü öffnen und vom USB Stick booten. 5. Dem Installationsassistenten folgen und bei der Auswahl der Partitionen, alle löschen. 6. "Nicht zugewiesener Speicherplatz" auswählen und die Installation starten (Partitionen werden automatisch erstellt). 7. Sobald der Ersteinrichtungsassistent startet, die Taste F10 drücken und im sich öffnenten Fenster folgendes eingeben: OOBE\BYPASSNRO und mit Enter bestätigen. Dadurch ist es möglich, Windows 11 mit einem lokalen Windows Benutzerkonto einzurichten, anstatt mit einem Microsoft Konto. Ich persönlich bevorzuge ein lokales Windows Benutzerkonto. 8. Nach erneutem Start des Ersteinrichtungsassistenten, diesem folgen. Sobald gefragt wird nach dem Internet, einfach folgendes auswählen: "Ich habe kein Internet" Dies wird erst durch die oben beschriebene Maßnahme unter Punkt 7 zur Auswahl angeboten. 9. Nach dem man sich durch Ersteinrichtungsassistenten durchgearbeitet hat, startet das erste mal Windows 11 und man befindet sich auf dem Desktop. 10. Als nächstes offline also ohne bestehende Internetverbindung, alle Treiber und das Alienware Command Center installieren. Zum Thema Treiberreihenfolge, werde ich mich zu einem späteren Zeitpunkt äußern, um nicht den Rahmen zu sprengen. 11. Bevor man online geht, in den Windows 11 Gruppenrichtlinien (nur in Windows 11 Pro enthalten) einstellen, das über Windows Update keine Gerätetreiber installiert bzw. aktualisiert werden. Dadurch wird auch das BIOS nicht automatisch über Windows Update aktualisiert. Kurz eine Erklärung wie man dies einstellt: Öffnen Sie den Gruppenrichtlinien-Editor ( gpedit.msc ), navigieren Sie zu Computerkonfiguration > Administrative Vorlagen > Windows-Komponenten > Windows Update > Vom Windows Update angebotene Updates verwalten und aktivieren Sie die Richtlinie Keine Treiber in Windows Updates einschließen. Danch Windows neustarten. 12. Online gehen und Windows Updates usw. installieren, so wie man sein System haben möchte. Was haltet ihr von dieser sehr detaillierten von mir beschriebenen und selbst erarbeiteten Vorgehensweise, zur Neuinstallation von Windows 11, mit allen Treiber und dem Alienware Command Center, inklusive eines lokalen Windows Benutzerkontos? Vielleicht konnte ich auch einigen helfen? Diese Anleitung lässt sich auch problemlos auf andere Alienware Laptops übertragen, wie bspw. dem Alienware m18 R1 oder dem Alienware m18 R2, um nur zwei Beispiele zu nennen. Auch weitere sollten möglich sein. Bin gespannt auf eure Meinung!!!

-

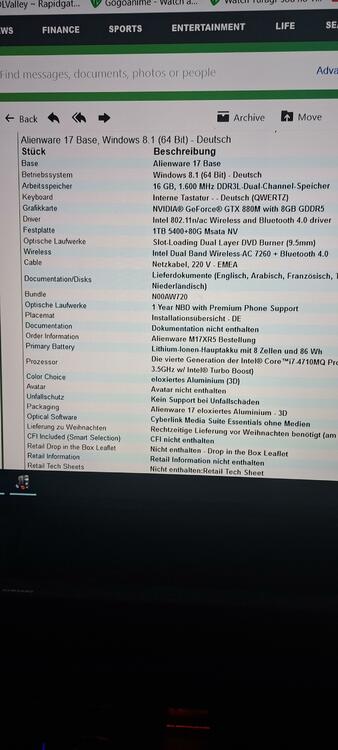

Hallo, Ich habe immer Probleme wenn ich etwas für meine Alienware 17 Notebook suche da ich keine eindeutige Bezeichnung für ihn finde! Es ist ein 17er , Am Bord steht 29.04.2013, Er hat einen M-Sata- und 2 SSD Steckplatz (Keinen Steckplatz für M2 Speicher) 4 Ram Steckplätze einen Steckplatz für eine GPU einen Steckplatz für die CPU usw Im hiesigen Gerätelexikon würde vieles für den 17 R1 sprechen. Allerdings ist auf einem der dazugehörigen Bilder zu sehen das der dort zum Starten einen Alienware-Kopf in der Mitte über der Tastatur hat! Meiner hat links über der Tastatur einen länglichen Startknopf! Kann mir jemand die richtige Bezeichnung für meine nennen?

-

Hallo zusammen Ich möchte mir einen der neuen 2025 Alienware Laptops holen. Die sollen, ich glaube, am 18.04.2025 herauskommen. Dachte an einen 17". Habt ihr da schon Informationen darüber. Hatte Anfang des Jahres ein Alienware m18 R2, dieser wurde schon nach dem ersten Start, ohne dass ein Programm lief heiß. Konnte ihn zurückschicken. Habt ihr vielleicht schon Informationen über die neuen 2025 Aliens? Habe noch 7.103 Rewards Punkte, aber die verfallen am 15.4.2025. DELL Chat sagt da kann man nichts machen.

-

Ich interessiere mich für ein aktuelles Notebook von Alienware. Sowohl das m16 R2 als auch das m18 R2 haben beide laut DELL-Onlineshop kein deutsches Tastaturlayout. Ist das generell bei Alienware so oder sind einfach nur keine entsprechenden Geräte mehr verfügbar? Wurde eigentlich bereits eine neue Modellreihe angekündigt? Wenn ja, macht es dann aktuell überhaupt Sinn eines der "alten" Geräte zu kaufen?

-

Hallo bei meinem alienware m17x r2 flackert der Bildschirm. Habe schon denn Selbsttest gemacht keine Fehler. Im abgesicherten Modus ist das Bild normal. Habe denn alienware auch an einem externen Monitor angeschlossen und da flackert das Bild auch am externen Monitor. Hätte jemand einen Tipp für mich was ich noch tun könnte. Mfg David

-

Alle Modelle (Notebooks) Schrauben nachkaufen

2f4me erstellte Thema in Allgemeines & Troubleshooting

Hallo, an meinen Alienware Area 51 fehlt eine Schraube am Bodendeckel was für welche sind das ? -

Alle Modelle (Notebooks) neuer Alienware m18 R2

Sammy217 erstellte Thema in Kauftipps & Entscheidungshilfen

Moin zusammen Ich habe zurzeit einen AlienAera51m. Dieser macht leider wieder immer mehr Probleme. Bleibt sehr oft hängen. Die Performance von Chrome oder Fierefox, sowie vom Programmen z. B. bei Photoshop und Fusion360 u.s.w ist sehr langsam. Immer mit diesem Kreis der Anzeigt das er rechnet, früher war es der Wartebalken. Weiß nicht wie es jetzt heißt, kannte ich bisher nicht. Habe das Gerät seit 2019. Er wird stark beansprucht, auch mit Games z.B. World of Warcraft und andere. Spiele mit dem Gedanken, mir einen neuen zu kaufen. Den Alienware m18 R2. Mit dem "Intel® Core™ i7 14700HX Prozessor der 14. Generation (33 MB L3-Cache, 20 Cores, bis zu 5,5 GHz maximale Turbo-Frequenz)", der "NVIDIA® GeForce RTX™ 4070, 8 GB GDDR6" und den "32 GB, 2 x 16 GB, DDR5, 5.600 MT/s, Non-ECC, Dual-Channel" RAM Riegel. Als Storage die "1-TB-M.2-PCIe-NVMe-SSD". Ich habe noch aus meinen AlienAera51m, eine eine "Samsung 980 1 TB PCIe 3.0 (bis zu 3.500 MB/s) NVMe M.2 Internes Solid State Drive (SSD) (MZ-V8V1T0BW)", könnte ich die in den neuen Laptop verbauen? Dann noch eine Frage, ein "Intel® Core™ i9-14900HX Prozessor der 14. Generation (36 MB L3-Cache, 24 Cores, bis zu 5,8 GHz maximale Turbo-Frequenz)" kostet nur etwas mehr. Habe im Netz schlecht Bewertungen gelesen, dass der i9 schnell kaputtgeht. Wie würde eure Konfiguration aussehen? Gruß Sammy -

Alle Modelle (Notebooks) Treiber von nVidia modifizieren

Fufu erstellte Thema in Anleitungen & How To

Da es gerade bei bastellustigen Alienwarebenutzern immer wieder dazu kommt, dass Grafikkarten in Notebooks verbaut werden die Dell nicht nativ angeboten hatte, werden Änderungen notwendig um den Treiber von nVidia installieren zu können. Fast genauso häufig wie dieser Treiber benötigt wird ist auch die Frage danach wie man den Treiber anpasst. Fangen wir jedoch einen Schritt vorher an. Wieso muss ein passender Treiber überhaupt erst manuell angepasst werden um installiert zu werden? Hier liegt die Verantwortung bei nVidia und deren Hardwareerkennung. Der Treiber kontrolliert leider nicht nur die HardwareID der Grafikkarte sondern die Kombination aus Notebook und Karte. Wenn nun eine dieser Kombinationen vom Hersteller, in unserem Fall Dell, nicht an nVidia gemeldet wurde taucht die ID nicht in der Erkennung auf. Und genau hier setzen wir nun an und holen dies nach. -Wie ist die HardwareID aufgebaut? -Welche Datei muss ich ändern? -Welche Änderungen müssen vorgenommen werden? -Muss ich sonst noch etwas beachten? Wie ist die HardwareID aufgebaut? Die Hardware-ID der Grafikkarte finden wir im Geräte-Manager. Wenn noch kein Treiber installiert ist heißt unsere Grafikkarte dort "Standart-VGA", "Microsoft-Standart-Anzeigegerät" oder ähnliches. Dieser Name ändert sich später durch den Treiber. Um dieses Tutorial möglichst leicht verständlich und nachvollziehbar zu gestallten ist es nicht unwichtig zu wissen wie die benötigte HardwareID aufgebaut ist. Nehmen wir uns als Beispiel eine GTX680m in einem M17xR2. PCI\VEN_10DE&DEV_11A0&SUBSYS_043A1028 VEN_10DE = nVidia DEV_11A0 = GTX 680M 043A = M17xR2 1028 = Dell Welche Datei muss ich ändern? Nachdem wir versucht haben den neuen Treiber von nVidia zu installieren und dieser Versuch abgebrochen wurde findet sich der bereits entpackte Treiber auf der Festplatte, meist unter C:\NVIDIA\DisplayDriver\VERSION\Win8_WinVista_Win7_64\International\Display.Driver\ In diesem Ordner befinden sich u.a. folgende INF-Dateien. nvaci.inf Acer, Gateway nvami.inf Asus nvaoi.inf Apple nvbli.inf HP nvcti.inf Compal nvcvi.inf Clevo nvdmi.inf Dell nvfmi.inf Fujitsu nvfui.inf Siemens nvhmi.inf HP nvloi.inf LG nvlti.inf Lenovo nvmi.inf MSI nvqni.inf NEC nvszci.inf Sony nvtdi.inf Toshiba Qosmio nvtsi.inf Toshiba Welche Datei hiervon wir nun ändern ist prizipiell egal, denn bei der Installation werden ohnehin alle Dateien nach einer passenden HardwareID durchforstet. Der Ordnung halber verwende ich jedoch die "nvdmi.inf". Welche Änderungen müssen vorgenommen werden? Kommen wir nun zum Kernthema. Es sind nur zwei Zeilen die wir der Datei hinzufügen müssen. Die erste Zeile sagt dem Treiber, dass unsere HardwareID kompatibel ist. Um die Stelle der ersten Änderung zu finden ist es wichtig zu wissen welches Betriebssystem verwendet wird. Sucht jeweils die Zeile die zu eurem OS passt. 1.1 Vista [NVIDIA_SetA_Devices.NTamd64.6.0] 1.2 Win7 [NVIDIA_SetA_Devices.NTamd64.6.1] 1.3 Win8 [NVIDIA_SetA_Devices.NTamd64.6.2] 1.4 Win8.1 [NVIDIA_SetA_Devices.NTamd64.6.3] In der Zeile darunter tragen wir nun folgendes ein: %NVIDIA_DEV.11A0.043A.1028% = Section033, PCI\VEN_10DE&DEV_11A0&SUBSYS_043A1028 Natürlich müsst ihr diese Zeile euerer HardwareID entsprechend anpassen. Die zweite Zeile die wir ändern sagt dem Treiber wie er die Karte anschließend benennen soll. Sucht die folgende Zeilen (OS ist dieses mal egal): DiskID1 = "NVIDIA Windows (64 bit) Driver Library Installation Disk 1" NVIDIA = "NVIDIA" NVIDIA_A = "NVIDIA" In der Zeile darunter tragen wir nun unsere Karte ein. In unserem Beispiel wäre dies: NVIDIA_DEV.11A0.043A.1028 = "NVIDIA Tuschkasten GTX 680M" Auch diese Zeile muss etsprechend eurer HardwareID angepasst werden. Anschließend müssen wir nur noch die Datei speichern und die Installation neu starten. Hierzu folgende Datei ausführen: C:\NVIDIA\DisplayDriver\VERSION\Win8_WinVista_Win7_64\International\setup.exe Muss ich sonst noch etwas beachten? Da der Treiber nun modifiziert ist stimmt er nicht mehr mit der digitalen Signatur überein. Bei Vista und Win7 ist dies nicht weiter schlimm. Hier muss man nur bestätigen, dass der Treiber dennoch installiert werden soll. Ab Win8 hingegen muss zuerst die Installation von nicht signierten Treibern zugelassen werden. Hierzu die Eingabeaufforderung öffnen (WinTaste+X) und folgendes eingeben: bcdedit /set {current} testsigning yes Danch Windows neu starten und den Treiber installieren. Um die Installation nicht signierter Treiber wieder zu unterbinden erneut die Eingabeaufforderung öffnen und folgendes eingeben: bcdedit /set {current} testsigning no Auch diese Änderung wird erst nach einem Neustart wirksam.- 87 Antworten

-

- 25

-

-

-

Alle Modelle (Notebooks) Alienware 17 2014 RAM Erweiterung

Hedron erstellte Thema in Upgrades - Do-it-Yourself

Servus, ich hoffe das ist kein alt-backenes Thema, aber ich habe nichts richtiges auf meine Frage gefunden oder konnte es nicht richtig formulieren 🙂 Es geht um meinen 10 Jahre alten "Daddy", welchen ich mit wenig Geld ein bissl schneller machen möchte. Screenshot anbei...ich möchte ein bissl wieder Spiele zocken, da wäre ja der RAM eine prima Investition: Kann ich einfach die 2x 4 GB von der leicht zu erreichenden "Hinterseite" in die RAM Slots (siehe Screenshot) gegen 2x 8 GB DDR3L wechseln? Auf der "Vorderseite" wären da ja noch die anderen 2x 4 GB RAMs versteckt, da möchte ich ungern werkeln, so viele Schrauben lösen und die auch wechseln.... Das wären dann ja 24 GB, geht das überhaupt? Sonst lese ich immer nur 8 GB, 16 GB oder 32 GB... Vielen lieben Dank euch allen, Hedi -

Hi, ich bin immer mal wieder auf der Jagd nach funktionstüchtigen "Vintage" Alienware-Laptops. Also aus der Pre-Dell zeit. Einige Modelle sind mir ja geläufig. Area51 M5500/M5550, Aurora M7700, Area51 M9700/M9750 (teilweise auch als M17 betitelt) usw. Aber hat jemand eine gute Webseite, ein Wiki oder eine Auflistung aller oder so gut wie aller Alienware-Laptops, gerne auch inkl. Desktops. Wo man sich mal schlau machen kann, ab wann welche Modelle auf dem Markt kamen bzw. welche es überhaupt gibt? Würde bei der Suche echt helfen. EDIT: Ich habe per Suchfunktion zwar mal einen ähnlichen Beitrag gefunden, der ist aber mittlerweile über 10 Jahre alt und führte nicht zu einem passenden Ergebnis Danke LG Fabien

-

Hallo, ich habe mir diese https://www.amazon.de/dp/B0BGYMJBQF/ref=twister_B0C4Q4WZTK?_encoding=UTF8&psc=1 externe SanDisk PRO-G40 SSD gekauft und versucht, selbige über den schnellen Thunderbolt 3 (USB-C) Anschluss meines Alienware Area-51m R1 Notebooks anzuschließen. Dies ist laut DELL bzw. den technischen Daten des Notebooks mit Datenübertragungsraten von bis zu 40 GBit/s via Thunderbolt 3 möglich (siehe hier: .https://www.dell.com/support/manuals/de-de/alienware-17-area51m-laptop/alienware-area-51m-setup-and-specifications/links?guid=guid-12cd14bb-8db3-47d7-a090-15d75787517a&lang=de-de). Nach Anschluss der SSD leuchtet zwar die Betriebsanzeige auf, jedoch wird mir die SSD unter Windows 11 nicht angezeigt, weder im Explorer noch in der Datenträgerverwaltung. Auch ein Treiber-Update des Windows Thunderbolt 3 Treibers sowie der auf der DELL Support Seite für das o. a. Noteboook gelisteten Thunderbolt Treiber/Apps brachte nichts. Ich habe übrigens das als Zubehör mitgelieferte Thunderbolt 3 Kabel verwendet. Hat Jemand von Euch bei dem Alienware Area-51m R1 schon mal eine externe SSD via Thunderbolt 3 mit entsprechend hohen Übertragsungsraten erfolgreich angeschlossen? Kann es evtl. mit der Größe der externen SSD (1TB) zusammenhängen ggf. in Verbindung mit den anderen drei internen SSD's (zusammen ebenfalls 1TB)? An was könnte es noch liegen, dass es nicht funktioniert? Vorab herzlichen Dank für Eure Antworten/Ratschläge! 😊

-

Da ich immer wieder mal Problem mit dem Alienware-Update-Tool bzw. dem Update im SupportAssist hatte, habe ich etwas recherchiert und Urachenforschung betrieben. Der Fehler zeigt sich dadurch, dass Meldungen wie "Laufende Aufgabe - Warten bis die Aufgabe beendet ist" angezeigt werden. Kommt wohl recht häufig vor, das Netz ist voll mit solchen Berichten. Verursacht wird dies oft durch fehlerhafte Dateien des Alienware Update Service. Meine funktionierende Lösung: Ich habe mir ein kleines Batch angelegt, welches ich bei Bedarf per Rechtsklick mit Admin-Rechten starte. Danach läuft alles erstmal wieder problemfrei. Inhalt der .bat-Datei: rmdir /s /q "C:\ProgramData\Dell\UpdateService" pause Vielleicht hilft dies ja dem einen oder anderen... Denke nicht, dass es sich um ein m18-spezifisches Problem handelt.

-

Hallo, hab heute ein Problem bekommen, mein Alienware 18 Laptop bleibt beim Starten schwarz und piept 8x. Der Bildschirm hat davor so komisch geflackert. das Problem kam von jetzt auf gleich. Hab von den 880m auf die intrigierte gpu gewechselt kann es sein das die Intel Grafikkarte nen Abflug gemacht hat? Weil das echt komisch ist das die Geräte reihenweise sterben bei mir obwohl ich sie normal benutzt jabe

-

Liebe Community, seitdem ich kleine Kinder habe, kann ich meinen alten Gaming Desktop kaum noch zum Zocken nutzen, u.a. weil ich nur noch Abends Zeit finde und dann schlafende Kinder im Zimmer sind. Ich flüchte seitdem mit einem Asus G731gw (i7 und 2080 mobile) ins Wohnzimmer zum Spielen. Ich spiele hauptsächlich Stellaris, BG3 (oder ähnliche RPGs), früher auch Skyrim, Fallout oder Elite Dangerous VR. BG3 bringt den Laptop zum Jaulen, daher fürchte ich, dass das nicht mehr lange gut geht. Ich möchte meinen Desktop ganz aussortieren, auch um Platz zu sparen, und künftig nur noch mit einem Laptop arbeiten und spielen. Bis ca. 4000€ (weniger ist natürlich besser) würde ich gehen können, ohne eine Ehekrise herauf zu beschwören. Der Kauf kann auch ruhig im nächsten Frühjahr stattfinden, ich halte es noch aus. Für das Geld benötige ich einen Laptop, mit dem ich die nächsten 5 Jahre überstehe, der mich nicht zu Undervolting/Repasting nötigt (dafür habe ich keine Zeit mehr) und der im Arbeitsmodus halbwegs leise ist. Eine 4090er RTX scheint mir sinnvoll, um die nächsten Jahre "Ruhe" zu haben. Die Größe und das Gewicht sind mir relativ wumpe, ins Wohnzimmer kriege ich auch 5kg getragen. Meine Recherchen und Nachfragen haben die Wahl auf den m18 r1, den SCAR 16, das X40 Beast (mit optionaler Wasserkühlung) und mit Abstrichen den Omen 17 verengt (jeweils mit 4090). Gibt es hierzu Erfahrungen? Der m18 gefällt mir gut, nur die CPU scheint recht heißzulaufen. Für Feedback/Erfahrungsberichte wäre ich dankbar! Viele Grüße Cyber Heinz (sorry, bei Prefix habe ich nix passendes gefunden)

-

Hallöchen liebe AW-Community. Ich habe gestern einen Alienware 18 2014 als Schlachter gekauft und meinen etwas Hübscher zu machen. Neuer Bildschirm (da alter defekt wahrscheinlich Bildprozessor defekt oder Kabel) auch habe ich den Core i7 4910QM gegen einen i7 4930XM getauscht, versiffte Tastatur getauscht und keine Klebrigen Maustasten mehr. Gekauft für 220 Euro als Teildefekt. Dieser geht zwar aber war von vorne rein als Schlachter gedacht. Dieser wurde mir als Single 980m verkauft, als ich diesen gestern geöffnet habe waren dort 2 GTX980m verbaut. Nun ist die Frage das dass Bios nur eine erkennt, aber das SLI Kabel war an einer Karte nicht verbunden vielleicht liegt es daran. Was ich von euch Wissen möchte wie ich den Laptop auf beide 980m umbaue in dem anderen Laptop waren auch die 100Watt Kühler verbaut. Also ebenfalls Geld gesparrt. Ich bräuchte halt eine genaue Anleitung für das Upgrade das heißt Bios Version ist A15. Wie ich das Bios Unlocke und den Treiber Modde. Wie sieht das dann aus wegen den Updates der Treiber von NVIDIA muss ich dann den Treiber wieder Modifizeren? Und das ich dann vielleicht die 2 GTX 770m in den M18xR2 einbauen kann. Als Netzteil(e) habe ich zwei 330Watt Netzteile. Wäre euch sehr Dankbar. Und vielleicht mal sagen was ich dabei Falsch machen kann. Bezüglich Bios weil wenn tot dann Laptop tot wahrscheinlich.

-

Alle Modelle (Notebooks) Ssd in neuen Laptop einbauen

Nilhilist erstellte Thema in Anleitungen & How To

Hallo liebe Community, ich habe mir einen neue Laptop zugelegt, auch schon ein paar spiele usw. installiert. Nun würde ich gerne eine neue (größere) ssd Karte gegen die vorhandene tauschen. Ebenso würde ich in diesem Zuge auch gleich nochmal win11 neu aufsetzen wollen und quasi alles auf werkseinstellung setzen. Könnt ihr mir sagen wie ich da am einfachsten vorgehen sollte? vielen Dank im voraus -

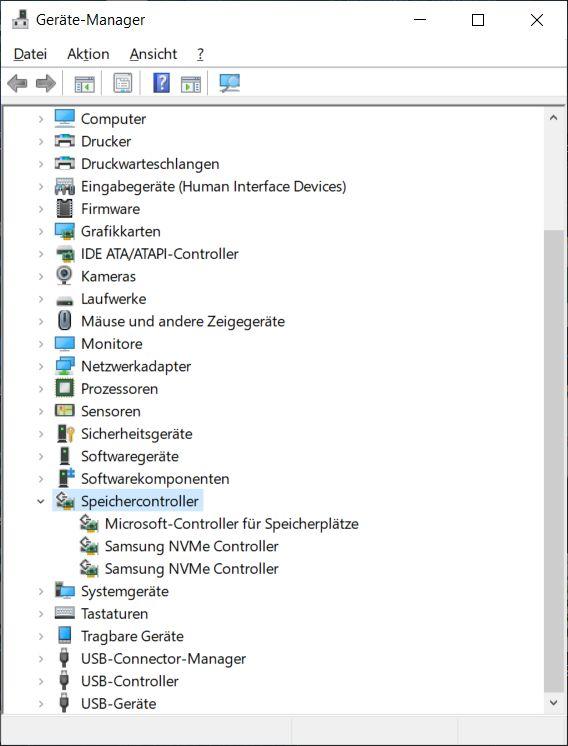

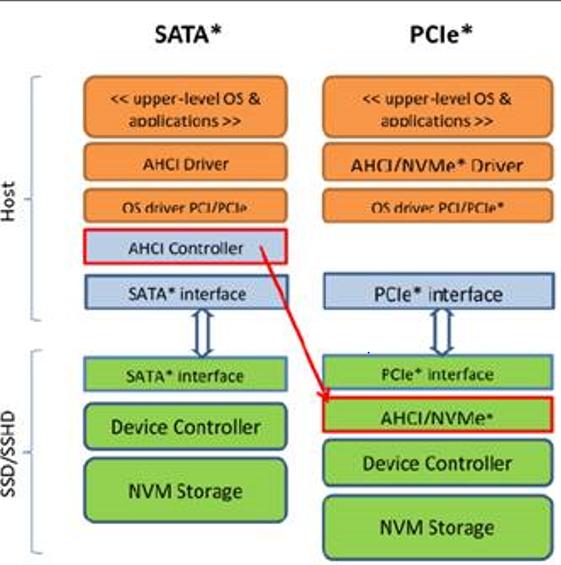

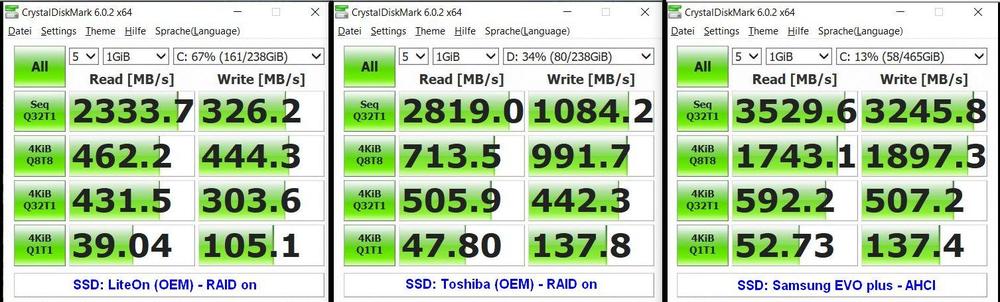

Durch die vielen Repastes ist mir schon häufiger aufgefallen, dass User, obwohl sie NVMe SSDs wie die Samsung 970 Evo plus verbaut haben, im standardmäßigen "RAID on" Modus unterwegs sind. Für PCIe NVMe SSDs ist der richtige Modus aber AHCI. Für diejenigen, die nicht genau wissen worum es geht, es ist im BIOS eine auswählbare Funktion wie die Speichercontroller angesprochen werden und mit dem Chipsatz/ System kommunizieren. Natürlich funktionieren die NVMe SSDs auch im RAID on Modus, jedoch sind hier dann einige Funktionen eingeschränkt oder stehen nicht zur Verfügung. Beispielsweise lässt sich die SSD nicht mit den herstellereigenen Tools öffnen und verwalten (Samsung Magician). Auch lässt sich der dazugehörige NVMe Treiber nicht installieren. Die Festplatte läuft dann auf einem Standard-Intel RST Treiber. Das lässt sich relativ einfach im Geräte-Manager nachprüfen: Da ich vor einiger Zeit zwei m15 hier hatte, habe ich ChrystalDiskMark durchlaufen lassen. Dabei war das Testgerät im RAID on Modus und hatte zwei NVMe SSDs verbaut. Mein Gerät ist im AHCI Modus und hat zwei Samsung 970 EVO Plus SSDs verbaut. So sehen die Ergebnisse aus: Gerade bei den Schreibgeschwindigkeiten ist der Unterschied doch schon enorm. Fairerweise muss aber auch sagen, dass das Testgerät mit den von Dell verbauten SSDs daherkam. Ich habe diese als OEM deklariert. Was mich jetzt brennend interessiert: wie performt die Samsung 970 SSD im RAID on Modus? Würde mich freuen wenn das jemand abchecken und online stellen könnte. Danke Ich hatte versucht Informationen dazu zu finden, aber wirklich verlässliche Infos habe leider nicht gefunden. Im XPS-Forum wurde wohl was von ca. 5% Leistungsverlust gesprochen, wobei der Beitrag auch schon mehrere Jahr alt ist. Samsung empfiehlt jedenfalls AHCI um den vollen Funktions- und Leistungsumfang nutzen zu können. Vor allem die volle Schreib- und Leseleistung soll nur mit dem Samsung NVMe Treiber möglich sein. Noch ein paar Anmerkungen: Hat man sein OS im RAID on Modus laufen, kann man nicht einfach auf AHCI wechseln. Das OS, welches im RAID on Modus installiert wurde, lässt sich dann nicht mehr booten. Möchte man AHCI nutzen, ist leider dafür eine Neuinstallation nötig. Den ChrystalDiskMark findet ihr -HIER-. Wie gesagt, würde mich freuen, wenn einer, der die Samsung 970 EVO Plus verbaut hat und im RAID on Modus ist, einen kurzen CrystalDiskMark durchlaufen lassen könnte. Einfach installieren und ausführen, keine weiteren Einstellungen nötig. Bin gespannt wie klein oder groß der Unterschied ausfällt.

-

Hallo ich bin jetzt seit fast zwei Jahren auf der Desktopschiene von Alienware unterwegs. Nun wollte ich mich mal bei euch bzgl. der aktuellen Probleme in dem nun doch massiv angewachsenen Line Up der Notebooksparte informieren. Daher wie sieht es aus mit: 1. ungleiche Coretemps auf CPU 2. ungleichmäßiger Anpressdruck des Heatsink auf CPU & GPU 3. Zugänglichkeit in Hinsicht auf einen Wechsel der Wärmeleitpaste 4. usability bzgl. Einstellungen OC/undervolt via Bios 5. Display Backlite Bleeding 6. Tonhöhe der Lüfter und Volllast bzw. Allgemeine Neuerungen im Kühlsystem? Welches der Systeme taugt da aktuell was (14/15/16/18 Zoll in den R und X Varianten)? Danke ihr seit dir besten!

-

Zur Info, weil es sich "wieder mal" zu häufen scheint: Auf älteren Maschinen knallt es jetzt in Verbindung mit dem neuesten Win 10 und Support Assist. Bluescreens, Freezes usw. Ich konnte das jetzt auf allen meinen Oldies reproduzieren. M15X, Area51 ALX, X51, X58. Also wenn es Probleme gibt, den SA als erstes mal deinstallieren. Spart ne Menge Zeit und Ärger 😏👽

-

Hallo, ich bin neu hier im Forum. Ich hatte auch vorher nie ein Alienware Produkt. Ich bin im Besitz eines neuen Laptops M17 R5. Gestern hatte mein Laptop ein irgendein Alienware Update durchgeführt. (Erst grüner Ladebalken, dann Neustart). Beim Neustart blieb der Bildschirm schwarz. Hatte dann irgendwann ausgeschaltet (Vielleicht war das der Fehler). Seitdem bleibt der Bildschwirm schwarz beim Neustart. Ich bin jetzt schon seit Stunden den Support am durchlesen. Wollte auch ein BIOS reset machen. Auch BIOS von USB Stick neu laden (Die aktuelle Version für meinen Laptop habe ich frisch von der Supportseite runtergeladen). Leider alles ohne Erfolg. Wollte den Premium Support anrufen. Aber die Nummer sei nicht vergeben. Ich hoffe, ich finde hier Hilfe. Grüße Sven

-

Guten Tag, ich habe vor einigen Tagen ein neues Notebook bestellt (X15 R2) Jetzt stellt sich mir die Frage wie eine perfekte Installation (Treiber sowie der Rest) der Reihe nach abläuft. Auf was muss ich achten? Am besten Schritt für Schritt erklärt. Konnte leider nichts aktuelles zu dem Thema finden, weshalb ich es hier nochmal aufgreifen möchte. Bedanke mich schonmal herzlich für die Antworten! Mfg Daniel